فهم إنتروبيا شجرة القرار في التعلم الآلي

نشرت: 2020-12-29شجرة القرار هي جزء من التعلم الآلي الخاضع للإشراف حيث تشرح المدخلات التي يكون ناتجها في بيانات التدريب. في أشجار القرار ، يتم تقسيم البيانات عدة مرات وفقًا للمعلمات المحددة. إنها تحافظ على تقسيم البيانات إلى مجموعات فرعية أصغر ، وفي الوقت نفسه ، يتم تطوير الشجرة بشكل تدريجي. تحتوي الشجرة على كيانين ، وهما عقد القرار والعقد الطرفية.

جدول المحتويات

الكيانات المختلفة لشجرة القرار

1. عقدة القرار

عقد القرار هي تلك التي يتم فيها تقسيم البيانات. عادة ما يكون له فرعين أو أكثر.

2. العقد الورقية

تمثل العقد الطرفية النتائج أو التصنيف أو القرارات الخاصة بالحدث. شجرة ثنائية لـ "الأهلية لمسابقة ملكة جمال الهند":

دعونا نأخذ مثالاً لشجرة ثنائية بسيطة لفهم أشجار القرار. دعونا نفكر في أنك تريد معرفة ما إذا كانت الفتاة مؤهلة لمسابقة ملكة جمال مثل Miss India.

تسأل عقدة القرار السؤال أولاً عما إذا كانت الفتاة مقيمة في الهند. إذا كانت الإجابة بنعم ، فهل يتراوح عمرها بين 18 و 25 عامًا؟ إذا كانت الإجابة بنعم ، فهي مؤهلة ، وإلا فلا. إذا كانت الإجابة لا ، فهل لديها شهادات صالحة؟ إذا كانت الإجابة بنعم ، فهي مؤهلة ، وإلا فلا. كانت هذه مشكلة بسيطة بنعم أو لا. يتم تصنيف أشجار القرار إلى نوعين رئيسيين:

يجب أن تقرأ: شجرة القرار في الذكاء الاصطناعي

تصنيف شجرة القرار

1. تصنيف الأشجار

أشجار التصنيف هي نوع الأشجار البسيط بنعم أو لا. إنه مشابه للمثال الذي رأيناه أعلاه ، حيث كان للنتيجة متغيرات مثل "مؤهل" أو "غير مؤهل". متغير القرار هنا قاطع.

2. أشجار الانحدار

في أشجار الانحدار ، يكون متغير النتيجة أو القرار مستمرًا ، على سبيل المثال ، حرف مثل ABC.

الآن بعد أن أصبحت على دراية كاملة بشجرة القرار ونوعها ، يمكننا الدخول في أعماقها. يمكن إنشاء أشجار القرار باستخدام العديد من الخوارزميات ؛ ومع ذلك ، فإن خوارزمية ID3 أو Dichotomiser 3 التكرارية هي الأفضل. هذا هو المكان الذي تدخل فيه إنتروبيا شجرة القرار في الإطار.

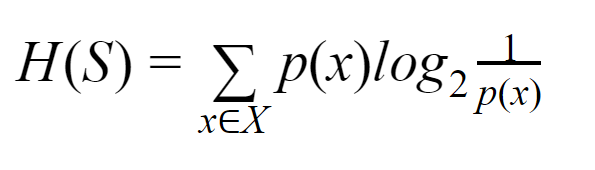

تمر خوارزمية ID3 في كل تكرار عبر سمة غير مستخدمة للمجموعة وتحسب Entropy H (s) أو IG (s) اكتساب المعلومات. نظرًا لأننا مهتمون أكثر بمعرفة إنتروبيا القرار في المقالة الحالية ، دعنا أولاً نفهم مصطلح Entropy ونجعله مبسطًا بمثال.

الانتروبيا: بالنسبة لمجموعة محدودة S ، فإن الانتروبيا ، وتسمى أيضًا شانون إنتروبي ، هي قياس مقدار العشوائية أو عدم اليقين في البيانات. يتم الإشارة إليه بواسطة H (S).

بعبارات بسيطة ، يتنبأ بحدث معين من خلال قياس النقاء. يتم إنشاء شجرة القرار بطريقة تنازلية وتبدأ بعقدة جذر. يتم تقسيم بيانات عقدة الجذر هذه أو تصنيفها إلى مجموعات فرعية تحتوي على مثيلات متجانسة.

على سبيل المثال ، ضع في اعتبارك طبقًا مستخدمًا في المقاهي مكتوب عليه "نحن منفتحون" على جانب واحد و "نحن مغلقون" على الجانب الآخر. احتمال "نحن منفتحون" هو 0.5 ، واحتمال "نحن مغلقون" هو 0.5. نظرًا لعدم وجود طريقة لتحديد النتيجة في هذا المثال بالذات ، فإن الانتروبيا هي أعلى درجة ممكنة.

بالعودة إلى نفس المثال ، إذا كانت اللوحة مكتوبة فقط "نحن منفتحون" على جانبيها ، فيمكن التنبؤ بالانتروبيا جيدًا لأننا نعلم بالفعل أنه إما الاحتفاظ بالجانب الأمامي أو الجانب الخلفي ، فما زلنا نواصل أن يكون لدينا "نحن منفتحون". بعبارة أخرى ، ليس لها عشوائية ، أي أن الانتروبيا تساوي صفرًا. يجب أن نتذكر أنه كلما انخفضت قيمة الانتروبيا ، زادت نقاء الحدث ، وكلما ارتفعت قيمة الانتروبيا ، انخفض نقاء الحدث.

قراءة: تصنيف شجرة القرار

مثال

دعونا نعتبر أن لديك 110 كرة. 89 من هذه الكرات الخضراء و 21 زرقاء. احسب الانتروبيا لمجموعة البيانات الإجمالية.

إجمالي عدد الكرات (ن) = 110

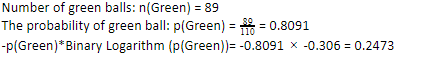

نظرًا لأن لدينا 89 كرة خضراء من 110 ، فإن احتمال اللون الأخضر سيكون 80.91٪ أو 89 مقسومًا على 110 ، وهو ما يعطينا 0.8091. علاوة على ذلك ، فإن احتمال ضرب الكرة الخضراء في سجل احتمالية اللون الأخضر يعطينا 0.2473. هنا ، يجب أن نتذكر أن سجل الاحتمالات سيكون دائمًا رقمًا سالبًا. لذلك ، علينا إرفاق إشارة سلبية. يمكن التعبير عن هذا ببساطة على النحو التالي:

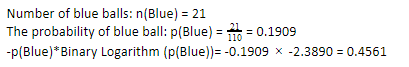

الآن ، بأداء نفس الخطوات للكرات الزرقاء ، لدينا 21 من 110. ومن ثم ، فإن احتمال الكرة الزرقاء هو 19.09٪ أو 21 مقسومًا على 110 ، وهو ما يعطينا 0.1909. علاوة على ذلك ، عند ضرب احتمال الكرات الزرقاء في سجل احتمالية الكرة الزرقاء ، نحصل على 0.4561. مرة أخرى ، كما هو موضح أعلاه ، سنقوم بإرفاق إشارة سلبية لأن سجل الاحتمال يعطي دائمًا نتيجة سلبية ، وهو ما لا نتوقعه. التعبير عن هذا ببساطة:

الآن ، يتم إعطاء شجرة القرار Entrop y للبيانات الإجمالية من خلال مجموع الانتروبيا الفردية. نحتاج إلى مجموع حاصل ضرب احتمال الكرة الخضراء ولوغاريتم احتمال الكرة الخضراء وحاصل ضرب احتمال الكرة الزرقاء ولوغاريتم احتمال الكرة الزرقاء.

الانتروبيا (البيانات الإجمالية) = 0.2473 + 0.4561 = 0.7034

كان هذا أحد الأمثلة لمساعدتك على فهم كيفية حساب الانتروبيا. آمل أن يكون الأمر واضحًا جدًا ، وقد فهمت هذا المفهوم. إن حساب إنتروبيا القرار ليس علمًا صارخًا على هذا النحو.

ومع ذلك ، يجب أن تكون حريصًا أثناء إجراء الحسابات. من خلال هذه الصفحة ، من الواضح أنك متحمس للتعلم الآلي ، وبالتالي ، من المتوقع أن تعرف مدى أهمية دور كل التفاصيل الدقيقة. حتى أصغر الأخطاء يمكن أن تسبب المتاعب ، وبالتالي ، يجب أن يكون لديك دائمًا حسابات مناسبة.

الخروج: أنواع الشجرة الثنائية

الحد الأدنى

يتم الإشراف على شجرة القرار في التعلم الآلي الذي يستخدم خوارزميات مختلفة لبناء شجرة القرار. من بين الخوارزميات المختلفة ، تستخدم خوارزمية ID3 Entropy. الانتروبيا ليست سوى مقياس لنقاء الحدث.

نحن نعلم أن مهنة التعلم الآلي لها مستقبل واعد ومهنة مزدهرة. لا يزال أمام هذه الصناعة طريق طويل للوصول إلى ذروتها ، وبالتالي فإن الفرص المتاحة لعشاق التعلم الآلي تنمو بشكل كبير مع الكثير من المزايا الأخرى. اجعل مكانك الرائع في صناعة التعلم الآلي بمساعدة المعرفة والمهارات المناسبة.

إذا كنت مهتمًا بمعرفة المزيد حول التعلم الآلي ، فراجع دبلوم PG في IIIT-B & upGrad في التعلم الآلي والذكاء الاصطناعي المصمم للمهنيين العاملين ويقدم أكثر من 450 ساعة من التدريب الصارم ، وأكثر من 30 دراسة حالة ومهمة ، IIIT- حالة الخريجين B ، أكثر من 5 مشاريع تتويجا عملية ومساعدة وظيفية مع أفضل الشركات.

ما هو الفرق بين الانتروبيا وجيني النجاسة؟

خوارزميات شجرة القرار هي طرق تصنيف تستخدم للتنبؤ بالحلول الممكنة والموثوقة. يتم حساب الانتروبيا في شجرة القرار لتحسينها. يتم اختيار هذه المجموعات الفرعية التي تكمل ميزات شجرة القرار لتحقيق درجة نقاء أكبر من خلال حساب Entropy. يحدد نقاء المكون في المجموعة الفرعية ويقسم المدخلات وفقًا لذلك. تقع الانتروبيا بين 0 إلى 1. يقيس جيني أيضًا شوائب البيانات لتحديد الانقسام الأكثر ملاءمة. يقيس مؤشر جيني أو شائبة جيني ما إذا كان التقسيم غير صحيح فيما يتعلق بسماته. من الناحية المثالية ، يجب أن يكون لجميع الانقسامات نفس التصنيف لتحقيق النقاء.

ما هو اكتساب المعلومات في أشجار القرار؟

تنطوي أشجار القرار على الكثير من الانقسام لتحقيق النقاء في المجموعات الفرعية. عندما تكون النقاوة هي الأعلى ، يكون توقع القرار هو الأقوى. اكتساب المعلومات هو عملية حسابية مستمرة لقياس الشوائب في كل مجموعة فرعية قبل تقسيم البيانات بشكل أكبر. يستخدم كسب المعلومات Entropy لتحديد هذا النقاء. في كل مجموعة فرعية ، تحدد نسبة المتغيرات المختلفة في المجموعات الفرعية مقدار المعلومات المطلوبة لاختيار المجموعة الفرعية لمزيد من التقسيم. سيكون اكتساب المعلومات أكثر توازناً في نسبة المتغيرات في المجموعة الفرعية ، مما يعد بمزيد من النقاء.

ما هي عيوب شجرة القرار؟

تعد خوارزمية شجرة القرار من أكثر آليات التعلم الآلي استخدامًا لاتخاذ القرار. على غرار الشجرة ، يستخدم العقد لتصنيف البيانات إلى مجموعات فرعية حتى يتم اتخاذ القرار الأنسب. تساعد أشجار القرار على توقع الحلول الناجحة. ومع ذلك ، لديهم حدودهم أيضًا. يصعب متابعة وفهم أشجار القرار العملاقة بشكل مفرط ؛ يمكن أن يكون هذا بسبب فرط تجهيز البيانات. إذا تم تعديل مجموعة البيانات بأي طريقة ، فسيتبع ذلك تداعيات في القرار النهائي. ومن ثم ، قد تكون أشجار القرار معقدة ولكن يمكن تنفيذها بشكل مناسب بالتدريب.