Das Beste aus vortrainierten Modellen herausholen

Veröffentlicht: 2022-03-11Die meisten der neu veröffentlichten Deep-Learning-Modelle, insbesondere im NLP, sind sehr, sehr groß: Sie haben Parameter, die von Hunderten Millionen bis zu Zehn Milliarden reichen.

Bei einer ausreichend guten Architektur gilt: Je größer das Modell, desto mehr Lernfähigkeit hat es. Daher haben diese neuen Modelle eine enorme Lernkapazität und werden auf sehr, sehr großen Datensätzen trainiert.

Aus diesem Grund lernen sie die gesamte Verteilung der Datensätze kennen, auf denen sie trainiert werden. Man kann sagen, dass sie komprimiertes Wissen dieser Datensätze kodieren. Dadurch können diese Modelle für sehr interessante Anwendungen verwendet werden – die häufigste ist das Transferlernen. Transfer Learning ist die Feinabstimmung vortrainierter Modelle für benutzerdefinierte Datensätze/Aufgaben, die weitaus weniger Daten erfordern, und Modelle konvergieren im Vergleich zum Training von Grund auf sehr schnell.

Wie vortrainierte Modelle die Algorithmen der Zukunft sind

Obwohl vortrainierte Modelle auch in der Computervision verwendet werden, konzentriert sich dieser Artikel auf ihre innovative Verwendung im Bereich der Verarbeitung natürlicher Sprache (NLP). Die Transformer-Architektur ist die häufigste und leistungsstärkste Architektur, die in diesen Modellen verwendet wird.

Obwohl BERT die Revolution des NLP-Transferlernens gestartet hat, werden wir die Modelle GPT-2 und T5 untersuchen. Diese Modelle sind vortrainiert – ihre Feinabstimmung für bestimmte Anwendungen führt zu viel besseren Bewertungsmetriken, aber wir werden sie sofort verwenden, dh ohne Feinabstimmung.

Vortrainierte NLP-Modelle: GPT-2 von OpenAI

GPT-2 löste bei seiner Veröffentlichung im Jahr 2019 eine ziemliche Kontroverse aus. Da es sehr gut darin war, Text zu generieren, zog es die Aufmerksamkeit der Medien auf sich und warf viele Fragen zur Zukunft der KI auf.

GPT-2 wurde mit 40 GB Textdaten trainiert und ist ein sehr großes Modell, das eine riesige Menge an komprimiertem Wissen aus einem Querschnitt des Internets enthält.

GPT-2 hat viele potenzielle Anwendungsfälle. Es kann verwendet werden, um die Wahrscheinlichkeit eines Satzes vorherzusagen. Dies wiederum kann für die Textautokorrektur verwendet werden. Als Nächstes kann die Wortvorhersage direkt verwendet werden, um eine Autovervollständigungskomponente für eine IDE (wie Visual Studio Code oder PyCharm) zum Schreiben von Code sowie zum allgemeinen Textschreiben zu erstellen. Wir werden es für die automatische Textgenerierung verwenden, und ein großer Textkorpus kann für die Analyse natürlicher Sprache verwendet werden.

Textgenerierung

Die Fähigkeit eines vortrainierten Modells wie GPT-2, kohärenten Text zu generieren, ist sehr beeindruckend. Wir können ihm einen Präfixtext geben und ihn bitten, das nächste Wort, die nächste Phrase oder den nächsten Satz zu generieren.

Ein beispielhafter Anwendungsfall ist das Generieren eines Datensatzes für Produktbewertungen, um zu sehen, welche Art von Wörtern im Allgemeinen in positiven Bewertungen im Vergleich zu negativen Bewertungen verwendet werden.

Schauen wir uns einige Beispiele an, beginnend mit dem, was wir bekommen, wenn wir mit dem positiven Präfix „Mir hat dieser Film wirklich gut gefallen!“ beginnen.

| Probe 1 | Liebte die Emotionen des Charakters, in ständiger Gefahr zu sein, und wie seine inneren Ängste durch diese Ereignisse langsam überwunden wurden. Liebte auch, dass er sich so aufs Überleben konzentrierte; selbst für eine Weile fühlte es sich so an, als würde immer wieder etwas aus Batman v Superman auftauchen, weil du immer wusstest, dass dein Feind irgendwann auftauchen würde :) Das Endthema ist mir auch wirklich hängen geblieben … ich meine, ja, das mussten sie … |

| Probe 2 | Es hat genau das gemacht, was ich wollte, es hat einfach viel Spaß gemacht. Die Besetzung war großartig und die Geschichte macht soweit Sinn, nachdem man alles andere bereits auf IMDB gesehen hat. Es gibt Hinweise darauf, dass sie aufgrund ihrer „Macht“ (oder ihres Fehlens) seit Urzeiten in einer unterirdischen Stadt waren, aber sie sagen nicht wirklich viel aus … Ich denke, es ist eher ein großes Rätsel als einige andere Aspekte, die sich für mich ergeben obwohl….Es soll… |

Wie Sie sehen können, war das Wort Bewertung nirgendwo im Präfix enthalten, aber da die meisten Bewertungen Titel sind, denen der Hauptteil der Bewertung folgt, zwang dies das Modell, sich an diese Verteilung anzupassen. Beachten Sie auch den Hinweis auf Batman v Superman .

Sehen wir uns ein weiteres Beispiel an. Anstelle einer Filmrezension versuchen wir, eine Produktrezension mit dem negativen Präfix „Ein Müllprodukt! Nicht kaufen."

| Probe 1 | Und bitte versuchen Sie NICHT, dies als Dünger für Ihre Gärten oder Rasenflächen zu verwenden – es wird ernsthafte Wasserschäden verursachen, wenn es von Fischen und Vögeln aufgenommen wird. Verwenden Sie es mit Vorsicht, da die Möglichkeit besteht, dass Pestizide in Haustierfutter enthalten sein können, das online in Bioläden erhältlich ist, wie zu „gute“ Namen wie Petsmart, PetSmart und Safeway. Wie giftig ist Lebensmittelverschwendung? Abfallprodukte können erhebliche Mengen beitragen - genug, damit selbst sehr… |

| Probe 2 | Niemand wird dir jemals wieder ein Stück von diesem Müll geben. Tun Sie sich und Ihrem Unternehmen einfach einen Gefallen und räumen Sie auf, bevor Sie es kaufen, um in Zukunft etwas Geld oder Bequemlichkeit zu sparen Sie können diese Flaschen in jedem Einzelhandelsgeschäft kaufen, aber hier ist, wie Sie… |

Auch hier kann das Präfix als Titel einer Produktbewertung abgeleitet werden, sodass das Modell beginnt, Text nach diesem Muster zu generieren. GPT-2 kann jede Art von Text wie diesen generieren.

Ein Google Colab-Notebook steht für Experimente bereit, ebenso wie die Live-Demo „Write With Transformer“.

Fragen beantworten

Ja, da GPT-2 im Internet trainiert wird, „kennt“ es eine Menge menschliches Wissen, das bis 2019 online veröffentlicht wurde. Es kann auch für kontextbezogene Fragen funktionieren, aber wir müssen das explizite Format von „ Frage: X, Antwort:“, bevor Sie die automatische Vervollständigung versuchen. Aber wenn wir das Modell zwingen, unsere Frage zu beantworten, kann es eine ziemlich vage Antwort geben. Folgendes passiert, wenn versucht wird, ihn zu zwingen, offene Fragen zu beantworten, um sein Wissen zu testen:

| Probe 1 | Frage: Wer hat die Evolutionstheorie erfunden? Antwort: Die Evolutionstheorie wurde erstmals 1859 von Charles Darwin aufgestellt. |

| Probe 2 | Frage: Wie viele Zähne hat der Mensch? Antwort: Der Mensch hat 21 Zähne. |

Wie wir sehen können, gab das vortrainierte Modell eine ziemlich detaillierte Antwort auf die erste Frage. Zum zweiten hat es sein Bestes gegeben, ist aber nicht mit der Google-Suche zu vergleichen.

Es ist klar, dass GPT-2 ein enormes Potenzial hat. Durch die Feinabstimmung kann es für die oben genannten Beispiele mit viel höherer Genauigkeit verwendet werden. Aber selbst der vortrainierte GPT-2, den wir evaluieren, ist immer noch nicht so schlecht.

Vortrainierte NLP-Modelle: Googles T5

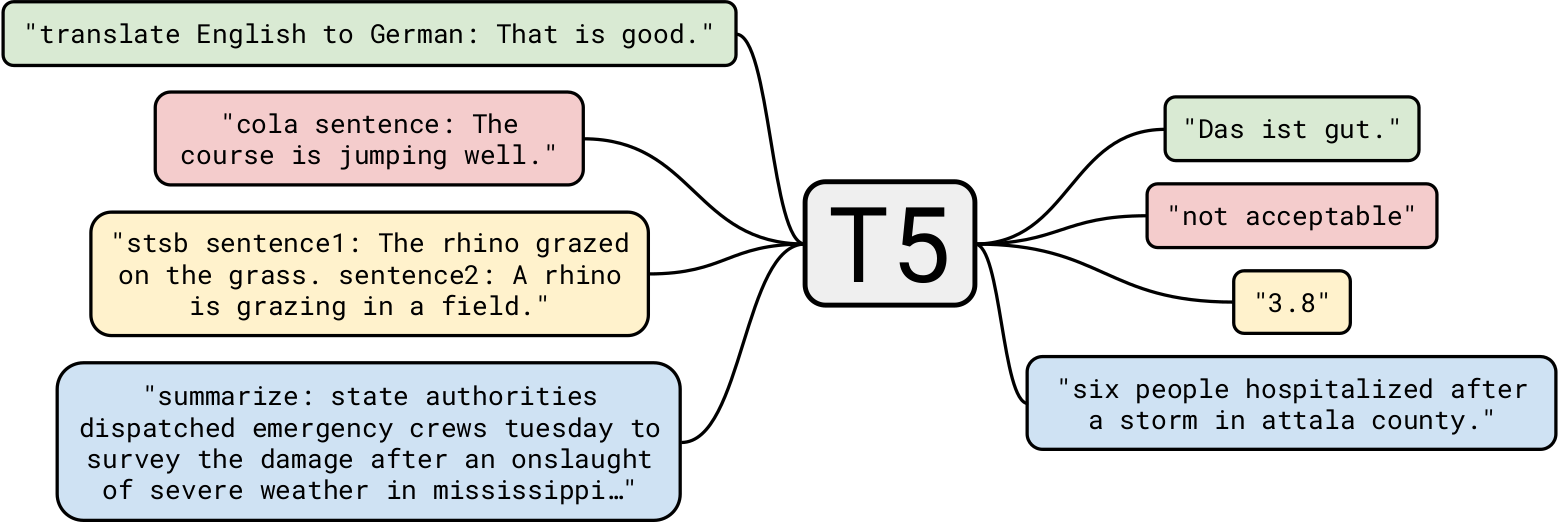

Googles T5 ist bis heute eines der fortschrittlichsten Modelle für natürliche Sprache. Es baut auf früheren Arbeiten zu Transformer-Modellen im Allgemeinen auf. Im Gegensatz zu BERT, das nur Encoder-Blöcke hatte, und GPT-2, das nur Decoder-Blöcke hatte, verwendet T5 beide .

Das Training von GPT-2 mit 40 GB Textdaten war bereits beeindruckend, aber T5 wurde mit einem 7-TB-Datensatz trainiert . Obwohl es für eine sehr, sehr große Anzahl von Iterationen trainiert wurde, konnte es nicht den gesamten Text durchlaufen. Obwohl T5 Textgenerierung wie GPT-2 durchführen kann, werden wir es für interessantere Geschäftsanwendungsfälle verwenden.

Zusammenfassung

Beginnen wir mit einer einfachen Aufgabe: Textzusammenfassung. Für KI-Entwicklungsunternehmen, die eine App erstellen möchten, die einen Nachrichtenartikel zusammenfasst, ist T5 perfekt für diese Aufgabe geeignet. Wenn Sie beispielsweise diesen Artikel an T5 weitergeben, sind hier drei verschiedene Zusammenfassungen, die daraus hervorgegangen sind:

| V1 | In der nächsten Staffel von Destiny 2, die am 10. März beginnt, werden die Schwerter überarbeitet. sie haben wiederaufladbare Energie, die sie sowohl für schwere Angriffe als auch für ihre Abwehr verwenden können . das valentinstagereignis, die purpurroten tage, findet ebenfalls diesen monat statt . |

| V2 | Bungie hat enthüllt, dass die nächste Staffel von Destiny 2 die Schwerter dramatisch überarbeiten wird. Das Studio war meistens schüchtern, was die Saison mit sich bringen wird. Das Umdenken wird es Schwertern ermöglichen, die Schilde aller Feinde teilweise zu umgehen. |

| V3 | Die nächste Staffel von Destiny 2 wird Schwerter überarbeiten und sie die Schilde aller Feinde umgehen lassen. die saison beginnt am 10. märz . Sie können Destiny 2 während der Crimson Days spielen, einem Valentinstag-Event. |

Wie wir sehen können, hat es eine ziemlich raffinierte Arbeit geleistet, um den Artikel zusammenzufassen. Außerdem unterscheidet sich jede Zusammenfassung von den anderen.

Das Zusammenfassen mit vortrainierten Modellen hat enorme potenzielle Anwendungen. Ein interessanter Anwendungsfall könnte sein, automatisch eine Zusammenfassung jedes Artikels zu generieren und diese für Leser, die nur eine Zusammenfassung wünschen, an den Anfang zu stellen. Es könnte weitergeführt werden, indem die Zusammenfassung für jeden Benutzer personalisiert wird . Wenn beispielsweise einige Benutzer kleinere Vokabeln haben, könnte ihnen eine Zusammenfassung mit weniger komplizierten Wortwahlen angezeigt werden. Dies ist ein sehr einfaches Beispiel, das jedoch die Leistungsfähigkeit dieses Modells demonstriert.

Ein weiterer interessanter Anwendungsfall könnte sein, solche Zusammenfassungen im SEO einer Website einzusetzen. Obwohl T5 trainiert werden kann, um automatisch sehr hochwertiges SEO zu generieren, kann die Verwendung einer Zusammenfassung sofort hilfreich sein, ohne das Modell neu zu trainieren.

Leseverständnis

T5 kann auch zum Leseverstehen verwendet werden, zB zum Beantworten von Fragen aus einem bestimmten Kontext. Diese Anwendung hat sehr interessante Anwendungsfälle, die wir später sehen werden. Aber fangen wir mit ein paar Beispielen an:

| Frage | Wer hat die Evolutionstheorie erfunden? |

| Kontext (Enzyklopädie Britannica) | Die Entdeckung fossiler Knochen großer ausgestorbener Säugetiere in Argentinien und die Beobachtung zahlreicher Finkenarten auf den Galapagosinseln gehörten zu den Ereignissen, denen zugeschrieben wird, dass sie Darwins Interesse an der Entstehung von Arten geweckt haben. 1859 veröffentlichte er On the Origin of Species by Means of Natural Selection, eine Abhandlung, die die Evolutionstheorie und vor allem die Rolle der natürlichen Selektion bei der Bestimmung ihres Verlaufs begründet. |

| Antworten | darwin |

Es wird nicht ausdrücklich erwähnt, dass Darwin die Theorie erfunden hat, aber das Modell nutzte sein vorhandenes Wissen zusammen mit einem gewissen Kontext, um zu der richtigen Schlussfolgerung zu gelangen.

Wie wäre es mit einem sehr kleinen Kontext?

| Frage | Wo sind wir hingegangen? |

| Kontext | An meinem Geburtstag beschlossen wir, die nördlichen Gebiete Pakistans zu besuchen. Das hat wirklich Spaß gemacht. |

| Antworten | nördliche gebiete von pakistan |

Okay, das war ziemlich einfach. Wie wäre es mit einer philosophischen Frage?

| Frage | Was ist der Sinn des Lebens? |

| Kontext (Wikipedia) | Der Sinn des Lebens, wie wir ihn wahrnehmen, leitet sich aus philosophischen und religiösen Betrachtungen und wissenschaftlichen Untersuchungen über Existenz, soziale Bindungen, Bewusstsein und Glück ab. Viele andere Themen sind ebenfalls beteiligt, wie z. B. symbolische Bedeutung, Ontologie, Wert, Zweck, Ethik, Gut und Böse, freier Wille, die Existenz eines oder mehrerer Götter, Vorstellungen von Gott, der Seele und dem Leben nach dem Tod. Die wissenschaftlichen Beiträge konzentrieren sich in erster Linie auf die Beschreibung verwandter empirischer Fakten über das Universum, die Erforschung der Zusammenhänge und Parameter des „Wie“ des Lebens. |

| Antworten | philosophische und religiöse Betrachtungen und wissenschaftliche Untersuchungen über Existenz, soziale Bindungen, Bewusstsein und Glück |

Obwohl wir wissen, dass die Antwort auf diese Frage sehr kompliziert ist, hat T5 versucht, eine sehr naheliegende, aber vernünftige Antwort zu finden. Hut ab!

Nehmen wir es weiter. Lassen Sie uns ein paar Fragen stellen, wobei wir den zuvor erwähnten Engadget-Artikel als Kontext verwenden.

| Frage | Um was geht es hierbei? |

| Antworten | Destiny 2 wird dramatisch überarbeitet |

| Frage | Wann können wir mit diesem Update rechnen? |

| Antworten | 10. März |

Wie Sie sehen können, ist die kontextbezogene Fragebeantwortung von T5 sehr gut. Ein Anwendungsfall für Unternehmen könnte darin bestehen, einen kontextbezogenen Chatbot für Websites zu erstellen, der Anfragen beantwortet, die für die aktuelle Seite relevant sind.

Ein weiterer Anwendungsfall könnte darin bestehen, nach bestimmten Informationen in Dokumenten zu suchen, z. B. Fragen zu stellen wie: „Ist es ein Vertragsbruch, einen Firmenlaptop für ein persönliches Projekt zu verwenden?“ Verwenden eines Rechtsdokuments als Kontext. Obwohl T5 seine Grenzen hat, ist es für diese Art von Aufgabe ziemlich gut geeignet.

Leser fragen sich vielleicht: Warum nicht für jede Aufgabe spezielle Modelle verwenden? Das ist ein guter Punkt: Die Genauigkeit wäre viel höher und die Bereitstellungskosten spezialisierter Modelle wären viel niedriger als beim vortrainierten NLP-Modell von T5. Aber das Schöne an T5 ist genau, dass es „ein Modell ist, das alle beherrscht“, dh Sie können ein vortrainiertes Modell für fast jede NLP-Aufgabe verwenden. Außerdem möchten wir diese Modelle sofort verwenden, ohne Umschulung oder Feinabstimmung. Für Entwickler, die eine App erstellen, die verschiedene Artikel zusammenfasst, sowie eine App, die kontextbezogene Fragen beantwortet, kann dasselbe T5-Modell beides tun.

Vortrainierte Modelle: Die Deep-Learning-Modelle, die bald allgegenwärtig sein werden

In diesem Artikel haben wir uns mit vortrainierten Modellen und ihrer Verwendung für verschiedene geschäftliche Anwendungsfälle befasst. So wie ein klassischer Sortieralgorithmus fast überall für Sortierprobleme verwendet wird, werden diese vortrainierten Modelle als Standardalgorithmen verwendet. Es ist ziemlich klar, dass wir nur an der Oberfläche von NLP-Anwendungen gekratzt haben, und dass diese Modelle noch viel mehr tun können.

Vortrainierte Deep-Learning-Modelle wie StyleGAN-2 und DeepLabv3 können auf ähnliche Weise Anwendungen von Computer Vision unterstützen. Ich hoffe, dass Ihnen dieser Artikel gefallen hat und freue mich auf Ihre Kommentare unten.