Hutan Acak Vs Pohon Keputusan: Perbedaan Antara Hutan Acak dan Pohon Keputusan

Diterbitkan: 2020-12-30Kemajuan terbaru telah membuka pertumbuhan beberapa algoritma. Algoritme baru dan hebat ini telah membakar data. Mereka membantu dalam menangani data dan membuat keputusan dengan mereka secara efektif. Karena dunia berurusan dengan kesenangan internet. Hampir semuanya ada di internet. Untuk menangani data tersebut, kita membutuhkan algoritma yang ketat untuk membuat keputusan dan interpretasi. Sekarang, dengan adanya daftar algoritme yang luas, merupakan tugas berat untuk memilih yang paling cocok.

Algoritma pengambilan keputusan banyak digunakan oleh sebagian besar organisasi. Mereka harus membuat keputusan sepele dan besar setiap jam. Dari menganalisis bahan mana yang harus dipilih untuk mendapatkan area kotor tinggi, keputusan terjadi di backend. Kemajuan python dan ML baru-baru ini telah mendorong standar untuk menangani data. Dengan demikian, data hadir dalam jumlah besar. Ambang batas tergantung pada organisasi. Ada 2 algoritma keputusan utama yang banyak digunakan. Pohon Keputusan dan Hutan Acak- Kedengarannya familiar, bukan?

Pohon dan hutan!

Mari kita telusuri ini dengan contoh mudah.

Misalkan Anda harus membeli paket Rs. 10 biskuit manis. Sekarang, Anda harus memutuskan satu di antara beberapa merek biskuit.

Anda memilih algoritma pohon keputusan. Sekarang, ia akan memeriksa Rs. 10 paket, yang manis. Ini akan memilih biskuit yang paling banyak terjual. Anda akan memutuskan untuk pergi untuk Rs. 10 biskuit coklat. Anda senang!

Tapi teman Anda menggunakan algoritma hutan Acak. Sekarang, dia telah membuat beberapa keputusan. Selanjutnya, memilih keputusan mayoritas. Dia memilih di antara berbagai rasa stroberi, vanila, blueberry, dan jeruk. Dia memeriksa bahwa Rs tertentu. 10 paket disajikan 3 unit lebih banyak dari yang asli. Itu disajikan dalam cokelat vanila. Dia membeli biskuit vanilla choco itu. Dia yang paling bahagia, sementara kamu dibiarkan menyesali keputusanmu.

Bergabunglah dengan Kursus Online Pembelajaran Mesin dari Universitas top dunia – Magister, Program Pascasarjana Eksekutif, dan Program Sertifikat Tingkat Lanjut di ML & AI untuk mempercepat karier Anda.

Daftar isi

Apa perbedaan antara Pohon Keputusan dan Hutan Acak?

1. Pohon Keputusan

Sumber

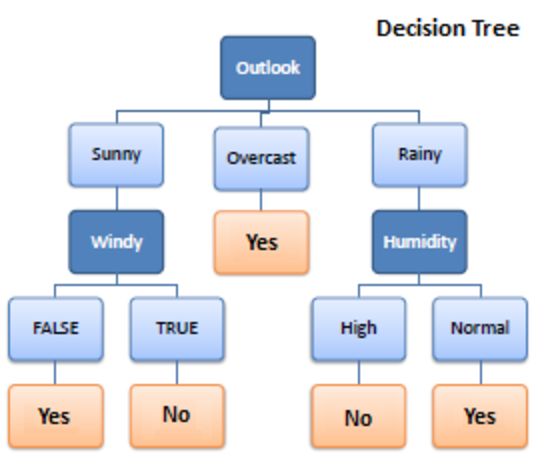

Decision Tree adalah algoritma pembelajaran terawasi yang digunakan dalam pembelajaran mesin. Ini beroperasi di kedua klasifikasi dan algoritma regresi. Seperti namanya, itu seperti pohon dengan simpul. Cabang tergantung pada jumlah kriteria. Ini membagi data menjadi cabang-cabang seperti ini sampai mencapai unit ambang batas. Sebuah pohon keputusan memiliki simpul akar, simpul anak, dan simpul daun.

Rekursi digunakan untuk melintasi node. Anda tidak perlu algoritma lain. Ini menangani data secara akurat dan bekerja paling baik untuk pola linier. Ini menangani data besar dengan mudah dan membutuhkan waktu lebih sedikit.

Bagaimana cara kerjanya?

1. Pemisahan

Data, ketika diberikan ke pohon keputusan, mengalami pemisahan menjadi berbagai kategori di bawah cabang.

Harus Dibaca: Naive Bayes Classifier: Pro & Kontra, Aplikasi & Jenis Dijelaskan

2. Pemangkasan

Pemangkasan adalah merobek-robek cabang-cabang itu lebih jauh. Ini berfungsi sebagai klasifikasi untuk mensubsidi data dengan cara yang lebih baik. Seperti, cara yang sama kita katakan memangkas bagian yang berlebih, cara kerjanya sama. Node daun tercapai, dan pemangkasan berakhir. Ini adalah bagian yang sangat penting dari pohon keputusan.

3. Pemilihan pohon

Sekarang, Anda harus memilih pohon terbaik yang dapat bekerja dengan data Anda dengan lancar.

Berikut faktor-faktor yang perlu diperhatikan:

4. Entropi

Untuk memeriksa homogenitas pohon, entropi perlu disimpulkan. Jika entropi adalah nol, itu homogen; lain tidak.

5. Perolehan pengetahuan

Setelah entropi berkurang, informasi diperoleh. Informasi ini membantu untuk membagi cabang lebih jauh.

- Anda perlu menghitung entropi.

- Pisahkan data berdasarkan kriteria yang berbeda

- Pilih informasi terbaik.

Kedalaman pohon merupakan aspek penting. Kedalaman memberi tahu kita tentang jumlah keputusan yang perlu dibuat sebelum kita sampai pada kesimpulan. Pohon kedalaman dangkal berkinerja lebih baik dengan algoritma pohon keputusan.

Keuntungan dan Kerugian Pohon Keputusan

Keuntungan

- Mudah

- Proses transparan

- Menangani data numerik dan kategorikal

- Semakin besar data, semakin baik hasilnya

- Kecepatan

Kekurangan

- Mungkin berlebihan

- Proses pemangkasan besar

- Pengoptimalan tidak dijamin

- Perhitungan rumit

- Defleksi tinggi

Lihat: Model Pembelajaran Mesin Dijelaskan

2. Hutan Acak

Sumber

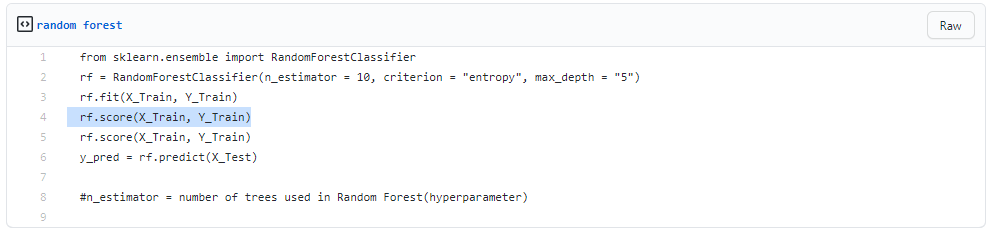

Ini juga digunakan untuk pembelajaran yang diawasi tetapi sangat kuat. Ini sangat banyak digunakan. Perbedaan mendasar adalah tidak bergantung pada keputusan tunggal. Ini mengumpulkan keputusan acak berdasarkan beberapa keputusan dan membuat keputusan akhir berdasarkan mayoritas.

Itu tidak mencari prediksi terbaik. Sebaliknya, itu membuat beberapa prediksi acak. Dengan demikian, lebih banyak keragaman yang melekat, dan prediksi menjadi lebih mulus.

Anda dapat menyimpulkan hutan Acak sebagai kumpulan beberapa pohon keputusan!

Bagging adalah proses membangun hutan acak sementara keputusan bekerja secara paralel.

1. mengantongi

- Ambil beberapa kumpulan data pelatihan

- Buatlah pohon keputusan

- Ulangi proses untuk jangka waktu tertentu

- Sekarang ambil suara utama. Salah satu yang menang adalah keputusan Anda untuk mengambil.

2. Bootstrap

Bootstraping adalah memilih sampel secara acak dari data pelatihan. Ini adalah prosedur acak.

Selangkah demi selangkah

- Kondisi pilih acak

- Hitung simpul akar

- Membelah

- Mengulang

- Anda mendapatkan hutan

Baca: Penjelasan Naive Bayes

Keuntungan dan Kerugian dari Hutan Acak

Keuntungan

- Kuat dan sangat akurat

- Tidak perlu dinormalisasi

- Dapat menangani beberapa fitur sekaligus

- Jalankan pohon secara paralel

Kekurangan

- Mereka terkadang bias pada fitur tertentu

- Lambat

- Tidak dapat digunakan untuk metode linier

- Lebih buruk untuk data dimensi tinggi

Kesimpulan

Pohon keputusan sangat mudah dibandingkan dengan hutan acak. Sebuah pohon keputusan menggabungkan beberapa keputusan, sedangkan hutan acak menggabungkan beberapa pohon keputusan. Jadi, ini adalah proses yang panjang, namun lambat.

Padahal, pohon keputusan cepat dan beroperasi dengan mudah pada kumpulan data besar, terutama yang linier. Model hutan acak membutuhkan pelatihan yang ketat. Saat Anda mencoba memasang proyek, Anda mungkin memerlukan lebih dari satu model. Jadi, sejumlah besar hutan acak, lebih banyak waktu.

Itu tergantung pada kebutuhan Anda. Jika Anda memiliki lebih sedikit waktu untuk mengerjakan sebuah model, Anda pasti akan memilih pohon keputusan. Namun, stabilitas dan prediksi yang andal ada di keranjang hutan acak.

Jika Anda memiliki semangat dan ingin mempelajari lebih lanjut tentang kecerdasan buatan, Anda dapat mengambil Diploma PG IIIT-B & upGrad dalam Pembelajaran Mesin dan Pembelajaran Mendalam yang menawarkan 400+ jam pembelajaran, sesi praktik, bantuan pekerjaan, dan banyak lagi.

Bagaimana hutan acak berbeda dari pohon keputusan normal?

Dalam pembelajaran mesin, Pohon Keputusan adalah teknik pembelajaran yang diawasi. Ia mampu bekerja dengan teknik klasifikasi dan regresi. Itu menyerupai pohon dengan node, seperti namanya. Jumlah kriteria menentukan cabang. Ini membagi data ke dalam cabang-cabang ini sampai mencapai unit ambang batas. Ada simpul akar, simpul anak, dan simpul daun di pohon keputusan. Hutan acak juga digunakan untuk pembelajaran yang diawasi, meskipun memiliki banyak kekuatan. Ini cukup populer. Perbedaan utama adalah bahwa hal itu tidak bergantung pada satu keputusan. Ini mengumpulkan keputusan acak berdasarkan banyak keputusan dan kemudian membuat keputusan akhir tergantung pada mayoritas.

Apa keuntungan utama menggunakan hutan acak versus pohon keputusan tunggal?

Di dunia yang ideal, kami ingin mengurangi kesalahan terkait bias dan terkait varians. Masalah ini ditangani dengan baik oleh hutan acak. Hutan acak tidak lebih dari serangkaian pohon keputusan dengan temuan mereka digabungkan menjadi satu hasil akhir. Mereka sangat kuat karena kemampuannya untuk mengurangi overfitting tanpa meningkatkan kesalahan secara besar-besaran karena bias. Hutan acak, di sisi lain, adalah alat pemodelan yang kuat yang jauh lebih tangguh daripada pohon keputusan tunggal. Mereka menggabungkan banyak pohon keputusan untuk mengurangi overfitting dan ketidakakuratan terkait bias, dan karenanya menghasilkan hasil yang dapat digunakan.

Apa yang dimaksud dengan batasan pohon keputusan?

Salah satu kelemahan pohon keputusan adalah sangat tidak stabil jika dibandingkan dengan prediktor pilihan lainnya. Sedikit perubahan pada data dapat menyebabkan perubahan signifikan dalam struktur pohon keputusan, yang menghasilkan hasil yang berbeda dari apa yang diharapkan konsumen dalam peristiwa biasa. Selanjutnya, ketika tujuan utamanya adalah untuk meramalkan hasil dari variabel kontinu, pohon keputusan kurang membantu dalam membuat prediksi.