Isotonische Regression beim maschinellen Lernen: Regressionen beim maschinellen Lernen verstehen

Veröffentlicht: 2020-12-21Es gibt verschiedene Arten von Regressionsmodellen (Algorithmen), die zum Trainieren von maschinellen Lernprogrammen verwendet werden, z. B. lineare, logistische, Ridge- und Lasso-Regression. Von diesen ist das lineare Regressionsmodell das grundlegendste und am weitesten verbreitete Regressionsmodell. Die isotonische Regression beim maschinellen Lernen basiert auf der linearen Regression. Bevor wir also zur isotonischen Regression übergehen, werfen wir zunächst einen Blick auf die lineare Regression beim maschinellen Lernen.

Inhaltsverzeichnis

Verständnis der linearen Regression beim maschinellen Lernen

Quelle

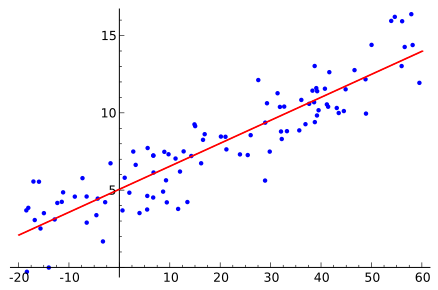

Das lineare Regressionsmodell wird verwendet, um die Beziehung zwischen den abhängigen und unabhängigen Variablen zu bestimmen. Es wird eine lineare Beziehung zwischen den beiden Variablen angenommen, die durch die beste Anpassungslinie dargestellt wird. Die Gleichung y= mx + c + e wird verwendet, um das lineare Regressionsmodell zu bezeichnen, wobei:

m= Steigung der Geraden

c= abfangen

e= Fehler im Modell

Das lineare Regressionsmodell ist anfällig für Ausreißer, sehr unflexibel und kann daher nicht für große Datenmengen verwendet werden. Wenn dieses Modell auf große Testdaten angewendet wird, gibt es mehrere Instanzen, die außerhalb der Neigung der Linie liegen, auch als Restfehler bezeichnet. Verfahren wie L1- und L2-Regularisierung können verwendet werden, um die Steilheit der Neigung der Linie zu verringern, aber sie erweisen sich als nicht so nützlich.

Muss gelesen werden: Modelle für maschinelles Lernen erklärt

Dies schränkt die Genauigkeit des maschinellen Lernalgorithmus ein. Um diese Grenze zu überwinden, wird ein neuer Ansatz der isotonischen Regression beim maschinellen Lernen verfolgt. Obwohl derzeit nicht weit verbreitet, ist dieser Ansatz sehr leistungsfähig und kann dazu beitragen, die Genauigkeit des maschinellen Lernprogramms zu verbessern.

Verständnis der isotonischen Regression beim maschinellen Lernen

Bevor wir in die technischen Dinge eintauchen, wollen wir die isotonische Regression beim maschinellen Lernen in Laiensprache verstehen .

Beginnen wir damit, das Wort „isotonisch“ zu entschlüsseln. Das Wort „isotonisch“ hat griechische Wortwurzeln und besteht aus zwei Teilen, „iso“ und „tonisch“. Hier bedeutet "iso" gleich und "tonisch" bedeutet dehnen. In Bezug auf maschinelle Lernalgorithmen kann die isotonische Regression daher als gleichmäßiges Strecken entlang der linearen Regressionslinie verstanden werden. Es arbeitet auf einem linearen Regressionsmodell.

Lassen Sie uns einen Blick auf verschiedene Aspekte der isotonischen Regression werfen, die uns helfen werden, sie besser zu verstehen.

1. Stückweises lineares Modell

Wie bereits erwähnt, muss die Steilheit der Steigung der linearen Regressionslinie minimiert werden, wofür L1- und L2-Regularisierungsverfahren verwendet werden. Der Ansatz der isotonischen Regression unterscheidet sich insgesamt dadurch, dass der Graph durch das Erstellen von Schwellenwerten in stückweise Abschnitte unterteilt wird und eine lineare Linie für jeden Abschnitt durchgehend verbunden ist.

Im obigen Bild kann die X-Achse beispielsweise weiter in verschiedene kleinere Abschnitte unterteilt werden, z. B. in gleiche Intervalle von 10. Jedes dieser Intervalle kann als Bins bezeichnet werden, z. B. Bin1, Bin2, Bin3, Bin4 usw an. Die lineare Gleichung wird daher jetzt zu

y= m1x1 + m2x2 + m3x3 +….. mnxn + c, wobei:

m1, m2, m3….mn = Steigung der Linie für einzelne Behälter.

Dies trägt dazu bei, den Fehler zu minimieren und die Steigung der Best-Fit-Linie zu reduzieren.

2. Nicht negative Steigung

Da eine isotonische Funktion eine monotone Funktion ist, ist die Steigung der Lösung immer nicht negativ. Eine Abnahme der Neigung ist beim Übergang von einer Schwelle zur anderen nicht zulässig. Der niedrigste Punkt in einer Schwelle sollte immer größer sein als der höchste Punkt in der vorherigen Schwelle.

Seien beispielsweise x1, x2, x3, x4…xn die Werte der Datenpunkte, die für die Steigung in den Bins b1, b2, b3, b4…bn betrachtet werden. Dann sollte die Steigung in der Regel nicht negativ sein. Somit,

f(x1) <= f(x2) <= f(x3) <= f(x4)…<= f(xn).

Wir beginnen also mit einem niedrigeren Punkt (wobei f(x1) der niedrigste Punkt ist) und bewegen uns allmählich mit jedem Schwellenwert zu einem höheren Punkt. Die Steigung eines Schwellenwerts kann Null sein (horizontale Linie), aber niemals negativ (Gefälle).

Lesen Sie: Projektideen für maschinelles Lernen für Anfänger

Vorteile der Verwendung der isotonischen Regression in maschinellen Lernmodellen

Die Verwendung der isotonischen Regression bietet zwei Hauptvorteile, die im Folgenden erörtert werden.

1. Mehrdimensionale Skalierung

Die isotonische Regression ist sehr hilfreich, wenn Sie mehrere Eingabevariablen haben. Wir können jede Dimension als jede Funktion untersuchen und linear interpolieren. Dies ermöglicht eine einfache mehrdimensionale Skalierung.

2. Kalibrierung von Wahrscheinlichkeitswerten

Angenommen, wir haben in der logistischen Regression eine Variable x und bezeichnen eine Wahrscheinlichkeit p(1), bei der der Wahrscheinlichkeitswert für die Variable nicht zunimmt. Aber in Wirklichkeit ist der Wahrscheinlichkeitswert in der realen Welt höher. In solchen Fällen erweist sich zu Kalibrierungszwecken oder zur Erhöhung der Wahrscheinlichkeit solcher Variablen die isotonische Regression als sehr hilfreich.

Schauen Sie sich an: Interviewfragen für maschinelles Lernen

Nachteile der Verwendung der isotonischen Regression in maschinellen Lernmodellen

Es gibt einen großen Nachteil bei der Verwendung der isotonischen Regression, der unten diskutiert wird.

Gefahr der Überanpassung

Es besteht ein erhebliches Risiko einer Überanpassung des Hyperparameters (K), wenn die Anzahl der isotonischen Einschränkungen und Prädiktorfunktionen zunimmt, aber die Cross-Validation-Workflow-Methode kann verwendet werden, um das Problem zu bewältigen.

Fazit

Derzeit haben nur drei große Sprachen Open-Source-Pakete mit isotonischer Regression. Betrachtet man jedoch die Vorteile der Verwendung der isotonischen Regression bei maschinellen Lernproblemen , werden der Umfang, die Verwendung und die Verfügbarkeit von isotonischen Regressionspaketen in Zukunft sicherlich zunehmen.

Wir können sehen, dass die isotonische Regression die lineare Regression und die L1- und L2-Normalisierungsmethoden weitgehend ersetzt. Um für die Zukunft gerüstet zu sein, ist es daher notwendig, sich von jetzt an auf dem Laufenden zu halten und sich über die isotonische Regression zu informieren!

Wenn Sie daran interessiert sind, mehr über die isotonische Regression beim maschinellen Lernen oder andere Konzepte im Zusammenhang mit maschinellem Lernen zu erfahren, können Sie sich das PG-Diploma in maschinellem Lernen und KI von IIIT-B und upGrad ansehen , das Indiens meistverkauftes Programm mit einer Bewertung von 4,5 Sternen ist . Der Kurs umfasst mehr als 450 Lernstunden, mehr als 30 Fallstudien und Aufgaben und hilft den Schülern, sich gefragte Fähigkeiten im Zusammenhang mit maschinellem Lernen und KI anzueignen.

Warum ist Regression beim maschinellen Lernen wichtig?

Die Regressionsanalyse, eine Art überwachter Lernalgorithmus, ist eines der grundlegenden Konzepte des maschinellen Lernens. Regression wird verwendet, um die Beziehung zwischen verschiedenen Variablen herzustellen, indem versucht wird abzuschätzen, wie der Wert der einen den der anderen beeinflusst. Im Bereich des maschinellen Lernens umfasst die Regression komplexe mathematische Algorithmen, die helfen, die Ergebnisse einer bestimmten Zielvariablen basierend auf den sich kontinuierlich ändernden Werten einer oder mehrerer Prädiktorvariablen zu schätzen. Die beliebteste Art der Regressionsanalyse ist die lineare Regression, da sie sehr einfach für Prognosen und Vorhersagen verwendet werden kann.

Ist maschinelles Lernen dasselbe wie Data Science?

Da Schlagworte wie Data Science und maschinelles Lernen heute zum Mainstream werden, sind viele Menschen oft verwirrt darüber, was sie eigentlich bedeuten. Lassen Sie uns versuchen, es hier schnell zu erklären. Data Science bezieht sich auf die Untersuchung riesiger Datenmengen, die von Organisationen generiert werden. Data Scientists wenden verschiedene Techniken an, um aus diesen Daten wertvolle Erkenntnisse zu gewinnen, damit Unternehmen maximalen Nutzen daraus ziehen und der Konkurrenz einen Schritt voraus sein können. Machine Learning unterscheidet sich von Data Science; Es setzt datenwissenschaftliche Techniken ein, um etwas über Daten zu lernen, die dann zum Trainieren von Maschinen verwendet werden. Maschinelles Lernen verwendet komplexe mathematische Modelle, um Computern zu helfen, ohne menschliches Eingreifen zu lernen.

Ist maschinelles Lernen dasselbe wie Deep Learning?

Maschinelles Lernen ist eine Teilmenge der künstlichen Intelligenz. Es verwendet Algorithmen oder Modelle, die Daten analysieren, daraus lernen und diese Erkenntnisse dann anwenden können, um Computern oder Maschinen dabei zu helfen, Entscheidungen ohne explizite menschliche Eingaben zu treffen. Andererseits ist Deep Learning ein Teilbereich des maschinellen Lernens. Es wird verwendet, um Algorithmen oder mathematische Modelle in Schichten zu strukturieren, um ein künstliches neuronales Netzwerk zu entwickeln, das der Struktur des menschlichen Gehirns ähnelt. Dieses neuronale Netzwerk kann selbst lernen und intelligente Entscheidungen treffen, indem es seinen eigenen logischen Rahmen verwendet und Daten analysiert.