Regresja izotoniczna w uczeniu maszynowym: zrozumienie regresji w uczeniu maszynowym

Opublikowany: 2020-12-21Istnieją różne typy modeli regresji (algorytmów), które są używane do trenowania programów uczenia maszynowego, takich jak regresja liniowa, logistyczna, grzbietowa i lasso. Spośród nich model regresji liniowej jest najbardziej podstawowym i najczęściej używanym modelem regresji. Regresja izotoniczna w uczeniu maszynowym opiera się na regresji liniowej. Dlatego zanim przejdziemy do regresji izotonicznej, przyjrzyjmy się najpierw regresji liniowej w uczeniu maszynowym.

Spis treści

Zrozumienie regresji liniowej w uczeniu maszynowym

Źródło

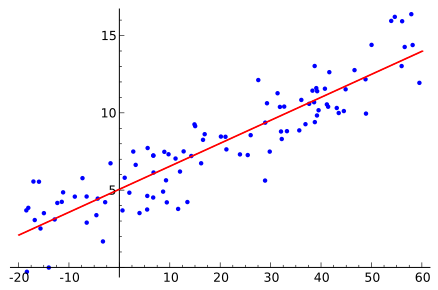

Model regresji liniowej służy do określenia relacji między zmienną zależną i niezależną. Zakłada relację liniową, reprezentowaną przez linię najlepszego dopasowania, między dwiema zmiennymi. Równanie y= mx + c + e służy do oznaczenia modelu regresji liniowej, gdzie:

m= nachylenie linii

c= przecięcie

e= błąd w modelu

Model regresji liniowej jest podatny na wartości odstające, wysoce nieelastyczny i dlatego nie może być używany do danych o dużym rozmiarze. Gdy ten model zostanie wdrożony na danych testowych o dużym rozmiarze, istnieje wiele przypadków, które leżą poza nachyleniem linii, zwanych również błędami szczątkowymi. Metody takie jak regularyzacja L1 i L2 mogą być stosowane do zmniejszania stromości nachylenia linii, ale nie okazują się one tak przydatne.

Trzeba przeczytać: Wyjaśnienie modeli uczenia maszynowego

Ogranicza to dokładność algorytmu uczenia maszynowego. Aby przezwyciężyć ten limit, przyjmuje się nowe podejście regresji izotonicznej w uczeniu maszynowym . Chociaż nie jest to obecnie rozpowszechnione, podejście to jest bardzo wydajne i może pomóc w poprawie dokładności programu uczenia maszynowego.

Zrozumienie regresji izotonicznej w uczeniu maszynowym

Zanim zagłębimy się w kwestie techniczne, zrozummy regresję izotoniczną w uczeniu maszynowym w kategoriach laika.

Zacznijmy od rozszyfrowania słowa „izotoniczny”. Słowo „izotoniczny” ma greckie korzenie i składa się z dwóch części: „iso” i „tonic”. Tutaj „iso” oznacza równe, a „toniczne” oznacza rozciąganie. W przypadku algorytmów uczenia maszynowego regresję izotoniczną można zatem rozumieć jako równe rozciąganie wzdłuż linii regresji liniowej. Działa na szczycie modelu regresji liniowej.

Przyjrzyjmy się różnym aspektom związanym z regresją izotoniczną, które pomogą nam lepiej ją zrozumieć.

1. Odcinkowy model liniowy

Jak wspomniano wcześniej, należy zminimalizować stromość nachylenia linii regresji liniowej, do czego stosuje się metody regularyzacji L1 i L2. Podejście regresji izotonicznej jest zupełnie inne, dzieląc wykres na odcinki, tworząc progi i mając linię liniową dla każdej sekcji połączonej od końca do końca.

Na przykład na powyższym obrazku oś X może być dalej podzielona na różne mniejsze sekcje, powiedzmy w równych przedziałach 10. Każdy z tych przedziałów można nazwać binami, na przykład bin1, bin2, bin3, bin4 itd. na. Dlatego równanie liniowe staje się teraz:

y= m1x1 + m2x2 + m3x3 +….. mnxn + c, gdzie:

m1, m2, m3….mn = nachylenie linii dla poszczególnych pojemników.

Pomaga to zminimalizować błąd i zmniejszyć nachylenie linii najlepszego dopasowania.

2. Nieujemne nachylenie

Ponieważ funkcja izotoniczna jest funkcją monotoniczną, nachylenie rozwiązania jest zawsze nieujemne. Zmniejszenie nachylenia nie jest dozwolone podczas przechodzenia z jednego progu na drugi. Najniższy punkt progu powinien zawsze być większy niż najwyższy punkt poprzedniego progu.

Na przykład, niech x1, x2, x3, x4…xn będą wartościami punktów danych branych pod uwagę dla nachylenia w przedziałach b1, b2, b3, b4…bn. Wtedy, zgodnie z regułą, nachylenie nie powinno być ujemne. Stąd,

f(x1) <= f(x2) <= f(x3) <= f(x4)…<= f(xn).

Tak więc zaczynamy od niższego punktu (gdzie f(x1) jest najniższym punktem) i stopniowo przechodzimy do wyższego punktu z każdym progiem. Nachylenie progu może wynosić zero (linia pozioma), ale nigdy nie może być ujemne (nachylenie w dół).

Przeczytaj: Pomysły na projekty uczenia maszynowego dla początkujących

Zalety stosowania regresji izotonicznej w modelach uczenia maszynowego

Stosowanie regresji izotonicznej oferuje dwie główne korzyści, które omówiono poniżej.

1. Skalowanie wielowymiarowe

Regresja izotoniczna jest bardzo pomocna, jeśli masz wiele zmiennych wejściowych. Możemy sprawdzić każdy wymiar jako każdą funkcję i interpolować go w sposób liniowy. Pozwala to na łatwe skalowanie wielowymiarowe.

2. Kalibracja wartości prawdopodobieństwa

W regresji logistycznej załóżmy, że mamy zmienną x i oznaczamy prawdopodobieństwo p(1), w którym wartość prawdopodobieństwa dla zmiennej nie wzrasta. Ale w rzeczywistości wartość prawdopodobieństwa jest wyższa w świecie rzeczywistym. W takich przypadkach, dla celów kalibracji lub zwiększenia prawdopodobieństwa takich zmiennych, bardzo pomocna okazuje się regresja izotoniczna.

Sprawdź: Pytania do rozmowy kwalifikacyjnej na temat uczenia maszynowego

Wady stosowania regresji izotonicznej w modelach uczenia maszynowego

Istnieje jedna główna wada stosowania regresji izotonicznej, którą omówiono poniżej.

Ryzyko nadmiernego dopasowania

Istnieje znaczne ryzyko nadmiernego dopasowania hiperparametru (K) wraz ze wzrostem liczby ograniczeń izotonicznych i cech predykcyjnych, ale do zarządzania problemem można zastosować metodę przepływu pracy z walidacją krzyżową.

Wniosek

Obecnie tylko trzy główne języki mają pakiety open-source z regresją izotoniczną. Jednak patrząc na korzyści płynące z zastosowania regresji izotonicznej w problemach z uczeniem maszynowym , zakres, użycie i dostępność pakietów regresji izotonicznej z pewnością wzrośnie w przyszłości.

Widzimy, że regresja izotoniczna w dużej mierze zastępuje regresję liniową oraz metody normalizacji L1 i L2. Dlatego, aby być gotowym na przyszłość, konieczne jest, aby od teraz być na bieżąco i mieć wiedzę na temat regresji izotonicznej!

Jeśli chcesz dowiedzieć się więcej o regresji izotonicznej w uczeniu maszynowym lub innych koncepcjach związanych z uczeniem maszynowym, możesz zapoznać się z IIIT-B i upGrad's PG Diploma in Machine Learning and AI , który jest najlepiej sprzedającym się programem w Indiach z oceną 4,5 gwiazdki . Kurs obejmuje ponad 450 godzin nauki, ponad 30 studiów przypadków i zadań, a także pomaga uczniom zdobywać pożądane umiejętności związane z uczeniem maszynowym i sztuczną inteligencją.

Dlaczego regresja jest istotna w uczeniu maszynowym?

Analiza regresji, rodzaj nadzorowanego algorytmu uczenia, jest jednym z podstawowych pojęć w uczeniu maszynowym. Regresji używa się do ustalenia związku między różnymi zmiennymi, próbując oszacować, jak wartość jednej wpływa na drugą. W dziedzinie uczenia maszynowego regresja obejmuje złożone algorytmy matematyczne, które pomagają oszacować wyniki określonej zmiennej docelowej na podstawie ciągle zmieniających się wartości jednej lub wielu zmiennych predykcyjnych. Najpopularniejszym rodzajem analizy regresji jest regresja liniowa, ponieważ jest bardzo łatwa w użyciu do tworzenia prognoz i predykcji.

Czy uczenie maszynowe to to samo co nauka o danych?

Ponieważ modne hasła, takie jak data science i uczenie maszynowe, stają się dziś głównym nurtem, wiele osób często czuje się zdezorientowanych, co tak naprawdę mają na myśli. Spróbujmy to szybko wyjaśnić. Nauka o danych odnosi się do badania ogromnych ilości danych generowanych przez organizacje. Analitycy danych stosują różne techniki, aby wydobyć cenne spostrzeżenia z tych danych, tak aby firmy mogły czerpać maksymalne korzyści i wyprzedzać konkurencję. Uczenie maszynowe różni się od nauki o danych; wykorzystuje techniki nauki o danych, aby poznać dane, które są następnie wykorzystywane do trenowania maszyn. Uczenie maszynowe wykorzystuje złożone modele matematyczne, aby pomóc komputerom uczyć się bez interwencji człowieka.

Czy uczenie maszynowe to to samo, co głębokie uczenie?

Uczenie maszynowe to podzbiór sztucznej inteligencji. Wykorzystuje algorytmy lub modele, które mogą analizować dane, uczyć się z nich, a następnie stosować te wnioski, aby pomóc komputerom lub maszynom w podejmowaniu decyzji bez wyraźnego wkładu człowieka. Z drugiej strony głębokie uczenie jest poddziedziną uczenia maszynowego. Służy do tworzenia warstwowych algorytmów lub modeli matematycznych w celu opracowania sztucznej sieci neuronowej, która przypomina strukturę ludzkiego mózgu. Ta sieć neuronowa może się sama uczyć i podejmować inteligentne decyzje, wykorzystując własne ramy logiczne i analizując dane.