شرح 7 أنواع من الشبكات العصبية في الذكاء الاصطناعي

نشرت: 2020-12-29الشبكات العصبية هي مجموعة فرعية من تقنيات التعلم الآلي التي تتعلم البيانات والأنماط بطريقة مختلفة باستخدام الخلايا العصبية والطبقات المخفية. تعد الشبكات العصبية أكثر قوة نظرًا لبنيتها المعقدة ويمكن استخدامها في التطبيقات التي لا تكفي فيها خوارزميات التعلم الآلي التقليدية.

بنهاية هذا البرنامج التعليمي ، ستكون لديك معرفة بما يلي:

- تاريخ موجز للشبكات العصبية

- ما هي الشبكات العصبية

- أنواع الشبكات العصبية

- بيرسبترون

- تغذية الشبكات إلى الأمام

- متعدد الطبقات المستقبلات

- الشبكات الشعاعية

- الشبكات العصبية التلافيفية

- الشبكات العصبية المتكررة

- شبكات الذاكرة طويلة المدى

جدول المحتويات

تاريخ موجز للشبكات العصبية

كان الباحثون من الستينيات يبحثون ويصوغون طرقًا لتقليد عمل الخلايا العصبية البشرية وكيفية عمل الدماغ. على الرغم من أن فك التشفير معقد للغاية ، فقد تم اقتراح بنية مماثلة والتي يمكن أن تكون فعالة للغاية في تعلم الأنماط المخفية في البيانات.

بالنسبة لمعظم القرن العشرين ، كانت الشبكات العصبية تعتبر غير كفؤة. كانت معقدة وكان أداؤها ضعيفًا. أيضًا ، لقد تطلبوا الكثير من قوة الحوسبة التي لم تكن متوفرة في ذلك الوقت. ومع ذلك ، عندما نشر فريق السير جيفري هينتون ، الملقب أيضًا باسم "أب التعلم العميق" ، الورقة البحثية حول Backpropagation ، انقلبت الجداول تمامًا. يمكن للشبكات العصبية الآن أن تحقق ما لم يتم التفكير فيه.

ما هي الشبكات العصبية؟

تستخدم الشبكات العصبية بنية الخلايا العصبية البشرية التي لها مدخلات متعددة ووحدة معالجة ومخرجات فردية / متعددة. هناك أوزان مرتبطة بكل اتصال من الخلايا العصبية. من خلال تعديل هذه الأوزان ، تصل الشبكة العصبية إلى معادلة تُستخدم للتنبؤ بمخرجات البيانات الجديدة غير المرئية. تتم هذه العملية عن طريق backpropagation وتحديث الأوزان.

أنواع الشبكات العصبية

تُستخدم أنواع مختلفة من الشبكات العصبية لبيانات وتطبيقات مختلفة. تم تصميم البنى المختلفة للشبكات العصبية خصيصًا للعمل على تلك الأنواع المعينة من البيانات أو المجال. لنبدأ من الأساسيات وننتقل إلى أكثرها تعقيدًا.

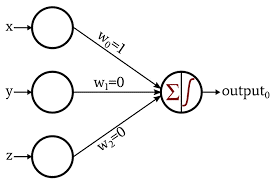

بيرسبترون

إن Perceptron هو الشكل الأساسي والأقدم للشبكات العصبية. يتكون من خلية عصبية واحدة فقط تأخذ المدخلات وتطبق وظيفة التنشيط عليها لإنتاج مخرجات ثنائية. لا يحتوي على أي طبقات مخفية ويمكن استخدامه فقط لمهام التصنيف الثنائي.

تقوم الخلية العصبية بمعالجة إضافة قيم الإدخال بأوزانها. ثم يتم تمرير المجموع الناتج إلى وظيفة التنشيط لإنتاج مخرجات ثنائية.

مصدر الصورة

تعرف على المزيد حول: Deep Learning vs Neural Networks

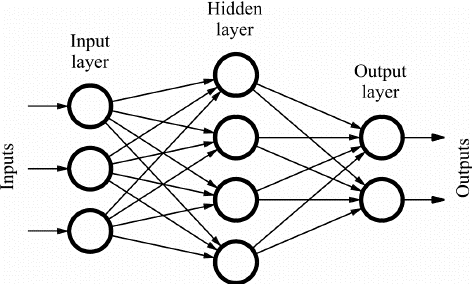

شبكة التغذية إلى الأمام

تتكون شبكات Feed Forward (FF) من خلايا عصبية متعددة وطبقات مخفية متصلة ببعضها البعض. وتسمى هذه "التغذية إلى الأمام" لأن البيانات تتدفق في الاتجاه الأمامي فقط ، ولا يوجد انتشار عكسي. قد لا تكون الطبقات المخفية موجودة بالضرورة في الشبكة اعتمادًا على التطبيق.

المزيد من عدد الطبقات يمكن أن يكون تخصيص الأوزان. وبالتالي ، ستكون قدرة الشبكة على التعلم أكثر. لم يتم تحديث الأوزان حيث لا يوجد backpropagation. يتم تغذية ناتج مضاعفة الأوزان مع المدخلات إلى وظيفة التنشيط التي تعمل كقيمة حدية.

تستخدم شبكات FF في:

- تصنيف

- التعرف على الكلام

- تمييز الوجوه

- التعرف على الأنماط

مصدر الصورة

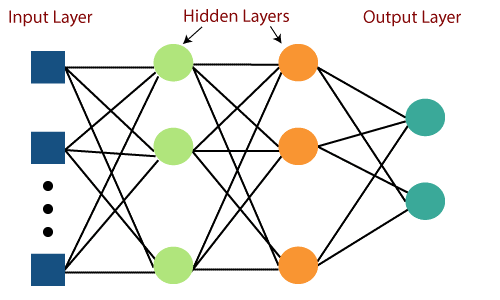

متعدد الطبقات المستقبلات

كان العيب الرئيسي لشبكات Feed Forward هو عدم قدرتها على التعلم باستخدام backpropagation. تعد المستشعرات متعددة الطبقات عبارة عن شبكات عصبية تتضمن عدة طبقات مخفية ووظائف التنشيط. يتم التعلم بطريقة خاضعة للإشراف حيث يتم تحديث الأوزان عن طريق هبوط التدرج.

متعدد الطبقات Perceptron ثنائي الاتجاه ، أي الانتشار الأمامي للمدخلات ، والانتشار الخلفي لتحديثات الوزن. يمكن أن تتغير وظائف التنشيط فيما يتعلق بنوع الهدف. عادةً ما يستخدم Softmax للتصنيف متعدد الفئات ، Sigmoid للتصنيف الثنائي وما إلى ذلك. وتسمى هذه أيضًا الشبكات الكثيفة لأن جميع الخلايا العصبية في طبقة ما مرتبطة بجميع الخلايا العصبية في الطبقة التالية.

يتم استخدامها في التطبيقات القائمة على التعلم العميق ولكنها بطيئة بشكل عام بسبب هيكلها المعقد.

مصدر الصورة

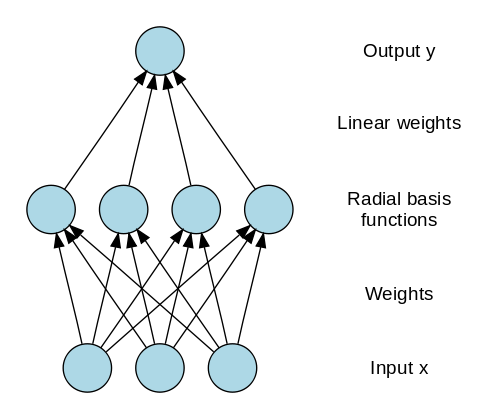

شبكات الأساس الشعاعي

تستخدم شبكات الأساس الشعاعي (RBN) طريقة مختلفة تمامًا للتنبؤ بالأهداف. يتكون من طبقة إدخال وطبقة بها خلايا عصبية RBF ومخرج. تخزن الخلايا العصبية RBF الفئات الفعلية لكل حالة من حالات بيانات التدريب. يختلف RBN عن الإدراك متعدد الطبقات المعتاد بسبب الوظيفة الشعاعية المستخدمة كوظيفة تنشيط.

عندما يتم تغذية البيانات الجديدة في الشبكة العصبية ، تقارن الخلايا العصبية RBF المسافة الإقليدية لقيم الميزة بالفئات الفعلية المخزنة في الخلايا العصبية. هذا مشابه لإيجاد الكتلة التي ينتمي إليها المثيل المعين. يتم تعيين الفئة التي تكون المسافة فيها الحد الأدنى للفئة المتوقعة.

تُستخدم RBNs في الغالب في تطبيقات تقريب الوظائف مثل أنظمة استعادة الطاقة.

مصدر الصورة

اقرأ أيضًا : تطبيقات الشبكة العصبية في العالم الحقيقي

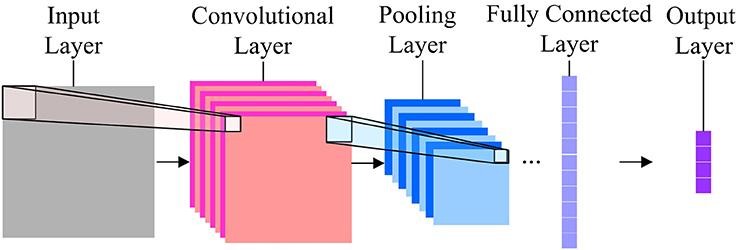

الشبكات العصبية التلافيفية

عندما يتعلق الأمر بتصنيف الصور ، فإن الشبكات العصبية الأكثر استخدامًا هي شبكات الالتفاف العصبية (CNN). تحتوي CNN على طبقات التفاف متعددة مسؤولة عن استخراج الميزات المهمة من الصورة. الطبقات السابقة مسؤولة عن تفاصيل المستوى المنخفض والطبقات اللاحقة مسؤولة عن المزيد من الميزات عالية المستوى.

تستخدم عملية الالتفاف مصفوفة مخصصة ، تسمى أيضًا مرشحات ، للالتفاف على الصورة المدخلة وإنتاج الخرائط. تتم تهيئة هذه المرشحات بشكل عشوائي ثم يتم تحديثها عبر backpropagation. أحد الأمثلة على هذا المرشح هو Canny Edge Detector ، والذي يستخدم للعثور على الحواف في أي صورة.

بعد طبقة الالتفاف ، توجد طبقة تجميع مسؤولة عن تجميع الخرائط الناتجة من الطبقة التلافيفية. يمكن أن يكون Max Pooling ، Min Pooling ، إلخ. للتنظيم ، تتضمن شبكات CNN أيضًا خيارًا لإضافة طبقات التسرب التي تسقط أو تجعل بعض الخلايا العصبية غير نشطة لتقليل فرط التخصيص وتقارب أسرع.

تستخدم شبكات CNN ReLU (الوحدة الخطية المصححة) كوظائف تنشيط في الطبقات المخفية. كطبقة أخيرة ، تحتوي شبكات CNN على طبقة كثيفة متصلة بالكامل ووظيفة التنشيط في الغالب مثل Softmax للتصنيف ، وفي الغالب ReLU للانحدار.

مصدر الصورة

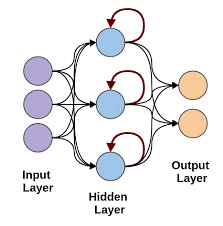

الشبكات العصبية المتكررة

تظهر الشبكات العصبية المتكررة في الصورة عندما تكون هناك حاجة للتنبؤات باستخدام البيانات المتسلسلة. يمكن أن تكون البيانات المتسلسلة عبارة عن سلسلة من الصور والكلمات وما إلى ذلك. تمتلك RNN بنية مشابهة لتلك الخاصة بشبكة Feed-Forward ، فيما عدا أن الطبقات تتلقى أيضًا إدخالًا متأخرًا زمنيًا لتنبؤ المثيل السابق. يتم تخزين تنبؤ المثيل هذا في خلية RNN والتي تعد إدخالًا ثانيًا لكل توقع.

ومع ذلك ، فإن العيب الرئيسي لـ RNN هو مشكلة التدرج التلاشي التي تجعل من الصعب للغاية تذكر أوزان الطبقات السابقة.

مصدر الصورة

شبكات الذاكرة طويلة المدى

تغلبت شبكات LSTM العصبية على مشكلة التلاشي التدرج في شبكات RNN عن طريق إضافة خلية ذاكرة خاصة يمكنها تخزين المعلومات لفترات طويلة من الزمن. يستخدم LSTM بوابات لتحديد المخرجات التي يجب استخدامها أو نسيانها. يستخدم 3 بوابات: بوابة الإدخال وبوابة الإخراج وبوابة النسيان. تتحكم بوابة الإدخال في ما يجب حفظ جميع البيانات في الذاكرة. تتحكم بوابة الإخراج في البيانات المعطاة للطبقة التالية وتتحكم بوابة النسيان عند تفريغ / نسيان البيانات غير المطلوبة.

تُستخدم LSTMs في تطبيقات مختلفة مثل:

- التعرف على الإيماءات

- التعرف على الكلام

- التنبؤ النصي

قبل ان تذهب

يمكن أن تصبح الشبكات العصبية معقدة للغاية في أي وقت من الأوقات حيث تستمر في إضافة طبقات في الشبكة. هناك أوقات يمكننا فيها الاستفادة من البحث الهائل في هذا المجال باستخدام شبكات مدربة مسبقًا لاستخدامنا.

وهذا ما يسمى نقل التعلم. في هذا البرنامج التعليمي ، قمنا بتغطية معظم الشبكات العصبية الأساسية وعملها. تأكد من تجربة ذلك باستخدام أطر عمل التعلم العميق مثل Keras و Tensorflow.

إذا كنت مهتمًا بمعرفة المزيد عن الشبكة العصبية والتعلم الآلي والذكاء الاصطناعي ، فراجع IIIT-B & upGrad's دبلوم PG في التعلم الآلي والذكاء الاصطناعي المصمم للمهنيين العاملين ويقدم أكثر من 450 ساعة من التدريب الصارم ، وأكثر من 30 دراسة حالة والمهام ، وحالة خريجي IIIT-B ، وأكثر من 5 مشاريع تتويجا عملية ومساعدة وظيفية مع كبرى الشركات.

ما هي الشبكات العصبية؟

الشبكات العصبية هي نماذج احتمالية يمكن استخدامها لإجراء التصنيف غير الخطي والانحدار ، مما يعني تقريب الخرائط من مساحة الإدخال إلى مساحة الإخراج. الشيء المثير للاهتمام حول الشبكات العصبية هو أنه يمكن تدريبها على الكثير من البيانات ، ويمكن استخدامها لنمذجة السلوك غير الخطي المعقد. يمكن تدريبهم بالعديد من الأمثلة ، ويمكن استخدامها للعثور على الأنماط دون أي توجيه. لذلك تُستخدم الشبكات العصبية في العديد من التطبيقات حيث توجد عشوائية وتعقيد.

ما هي الفئات الثلاث الرئيسية للشبكات العصبية؟

الشبكة العصبية هي نهج حسابي للتعلم ، مماثل للدماغ. هناك ثلاث فئات رئيسية للشبكات العصبية. التصنيف والتعلم التسلسلي والتقريب الوظيفي هي الفئات الثلاث الرئيسية للشبكات العصبية. هناك العديد من أنواع الشبكات العصبية مثل Perceptron و Hopfield والخرائط ذاتية التنظيم وآلات Boltzmann وشبكات المعتقدات العميقة والمشفرات التلقائية والشبكات العصبية التلافيفية وآلات Boltzmann المقيدة والشبكات العصبية ذات القيمة المستمرة والشبكات العصبية المتكررة وشبكات الارتباط الوظيفية.

ما هي حدود الشبكات العصبية؟

يمكن للشبكات العصبية حل المشكلات التي تحتوي على عدد كبير من المدخلات وعدد كبير من المخرجات. ولكن هناك أيضًا حدود للشبكات العصبية. تستخدم الشبكات العصبية في الغالب للتصنيف. أداؤهم سيء للغاية للتراجع. وهذه نقطة مهمة للغاية: تحتاج الشبكات العصبية إلى الكثير من بيانات التدريب. إذا كانت مجموعة البيانات صغيرة ، فلن تتمكن الشبكات العصبية من معرفة القواعد الأساسية. القيد الآخر للشبكات العصبية هو أنها صناديق سوداء. إنها ليست شفافة. ليس من السهل فهم البنية الداخلية للشبكة العصبية.