Spiegazione dell'albero decisionale nell'apprendimento automatico [con esempi]

Pubblicato: 2020-12-21introduzione

Decision Tree Learning è una tecnica di data mining tradizionale ed è una forma di apprendimento automatico supervisionato. Un albero decisionale è come un diagramma in cui le persone rappresentano una probabilità statistica o trovano il corso dell'accaduto, l'azione o il risultato. Un esempio di albero decisionale rende più chiara la comprensione del concetto.

I rami nel diagramma di un albero decisionale mostrano un probabile risultato, una possibile decisione o una reazione. Il ramo alla fine dell'albero decisionale visualizza la previsione o un risultato. Gli alberi decisionali vengono solitamente utilizzati per trovare una soluzione a un problema che diventa complicato da risolvere manualmente. Cerchiamo di capire questo in dettaglio con l'aiuto di alcuni esempi di albero decisionale.

Un albero decisionale è uno degli strumenti popolari e potenti utilizzati per la previsione e la classificazione dei dati o di un evento. È come un diagramma di flusso ma ha la struttura di un albero. I nodi interni degli alberi rappresentano un test o una domanda su un attributo; ogni ramo è il possibile risultato della domanda posta e il nodo terminale, chiamato anche nodo foglia, denota un'etichetta di classe.

In un albero decisionale, abbiamo diverse variabili predittive. A seconda di queste variabili predittive, prova a prevedere la cosiddetta variabile di risposta.

Lettura correlata: Classificazione dell'albero decisionale: tutto ciò che devi sapere

Albero decisionale in ML

Rappresentando alcuni passaggi sotto forma di sequenza, l'albero decisionale diventa un modo semplice ed efficace per comprendere e visualizzare le possibili opzioni decisionali e i potenziali risultati del range. Gli alberi decisionali sono utili anche per identificare le possibili opzioni e soppesare le ricompense ei rischi rispetto a ciascuna linea d'azione che può essere ottenuta.

Un albero decisionale viene distribuito in molte organizzazioni su piccola e larga scala come una sorta di sistema di supporto nel prendere decisioni. Poiché un esempio di albero decisionale è un modello strutturato, i lettori possono comprendere il grafico e analizzare come e perché una particolare opzione può portare a una decisione corrispondente. L' esempio dell'albero decisionale consente inoltre al lettore di prevedere e ottenere più soluzioni possibili per un singolo problema, comprendere il formato e la relazione tra diversi eventi e dati con la decisione.

A ogni risultato nell'albero è assegnato un numero di ricompensa e di rischio o un peso. Se mai utilizzi un albero decisionale, avrai ogni risultato finale con un possibile svantaggio e vantaggio. Per concludere correttamente il tuo albero, puoi estenderlo per il breve o il tempo necessario a seconda dell'evento e della quantità di dati. Prendiamo un semplice esempio di albero decisionale per capirlo meglio.

Considera i dati forniti che consistono nei dettagli di persone come: se sono bevitori, fumatori, il loro peso e l'età in cui queste persone sono morte.

| Nome | Bevitore | Fumatore | Peso | Età (morto) |

| Sam | sì | sì | 120 | 44 |

| Maria | No | No | 70 | 96 |

| Giona | sì | No | 72 | 88 |

| Taylor | sì | sì | 55 | 52 |

| Gio | No | sì | 94 | 56 |

| Harry | No | No | 62 | 93 |

Proviamo a prevedere se le persone moriranno in età più giovane o in età avanzata. Le caratteristiche come bevitore, fumatore e peso fungeranno da valore predittivo. Usando questi, considereremo l'età come una variabile di risposta.

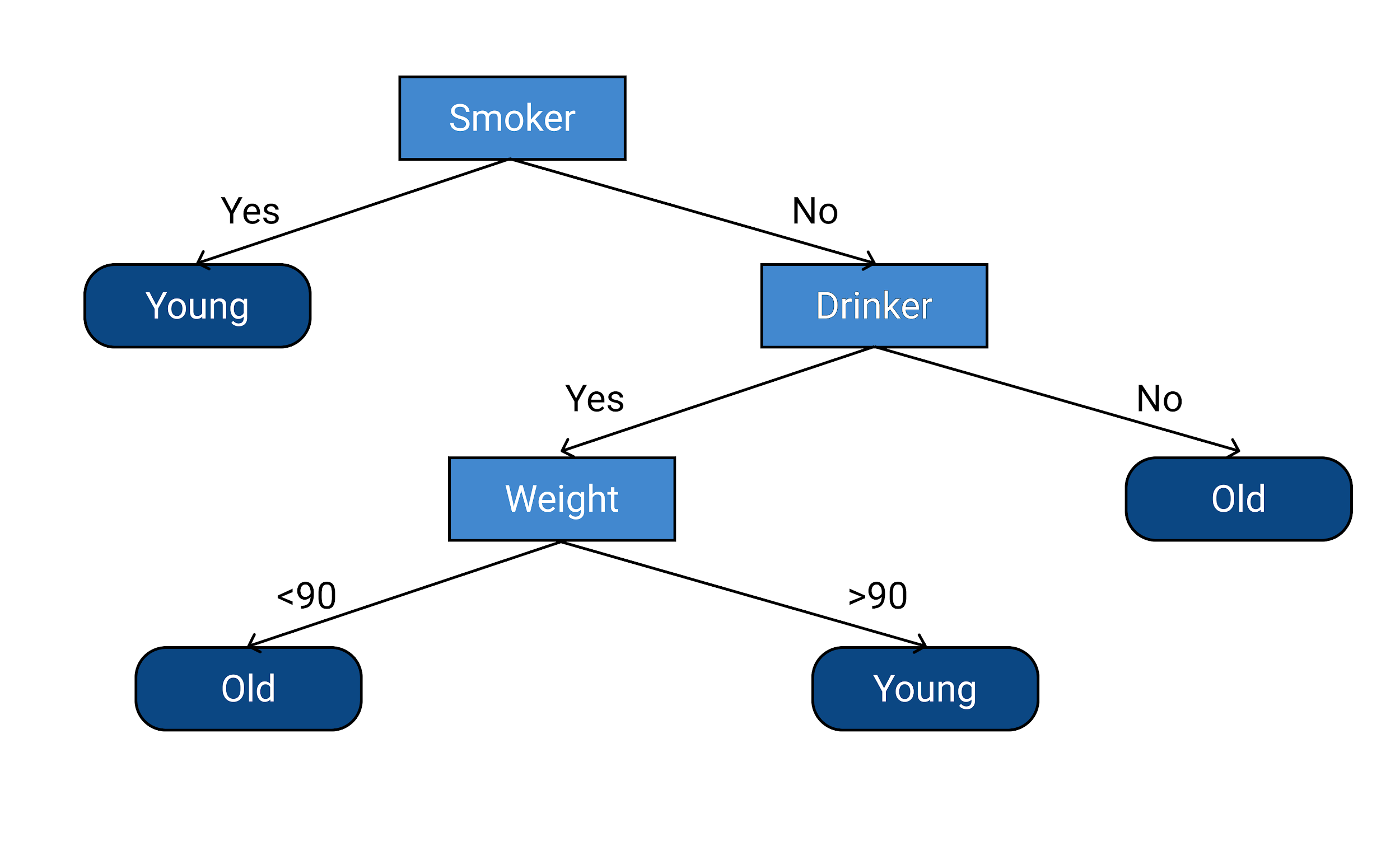

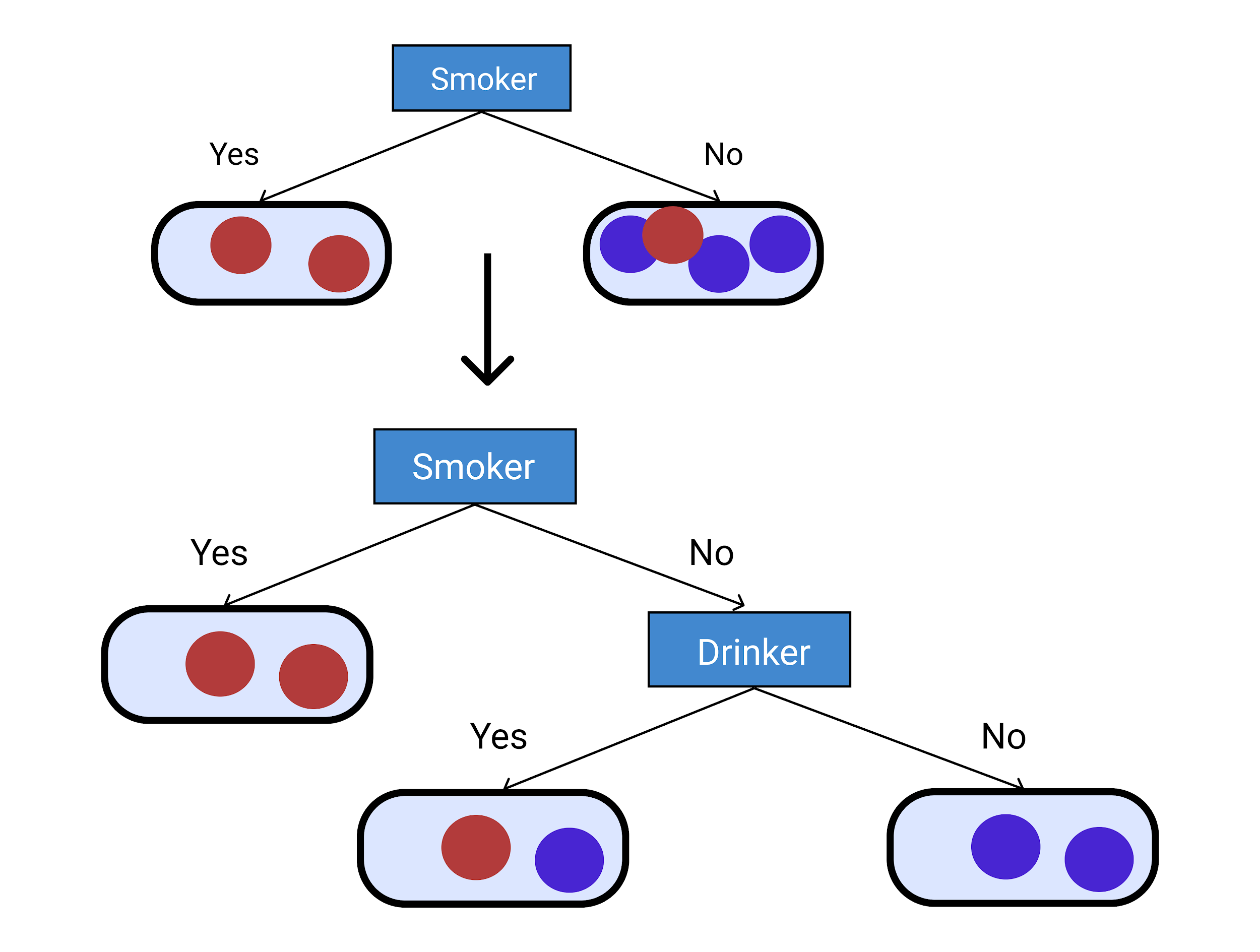

Etichettiamo che le persone che sono morte prima dei 70 anni sono morte "giovani" e le persone che sono morte dopo i 70 anni sono morte "vecchie". Prevediamo ora la variabile di risposta in base alla variabile predittiva. Di seguito è riportato un albero decisionale preso dopo aver appreso i dati.

L'albero decisionale sopra spiega che, se una persona è un fumatore, muore giovane. Se una persona non è un fumatore, il fattore successivo considerato è se la persona è un bevitore o meno. Se una persona non è un fumatore e non un bevitore, la persona muore vecchia.

Se una persona non è un fumatore ed è un bevitore, viene considerato il peso della persona. Se una persona non fuma, beve e pesa meno di 90 kg, la persona muore vecchia. E infine, se una persona non è fumatrice, bevitrice e pesa più di 90 kg, muore giovane.

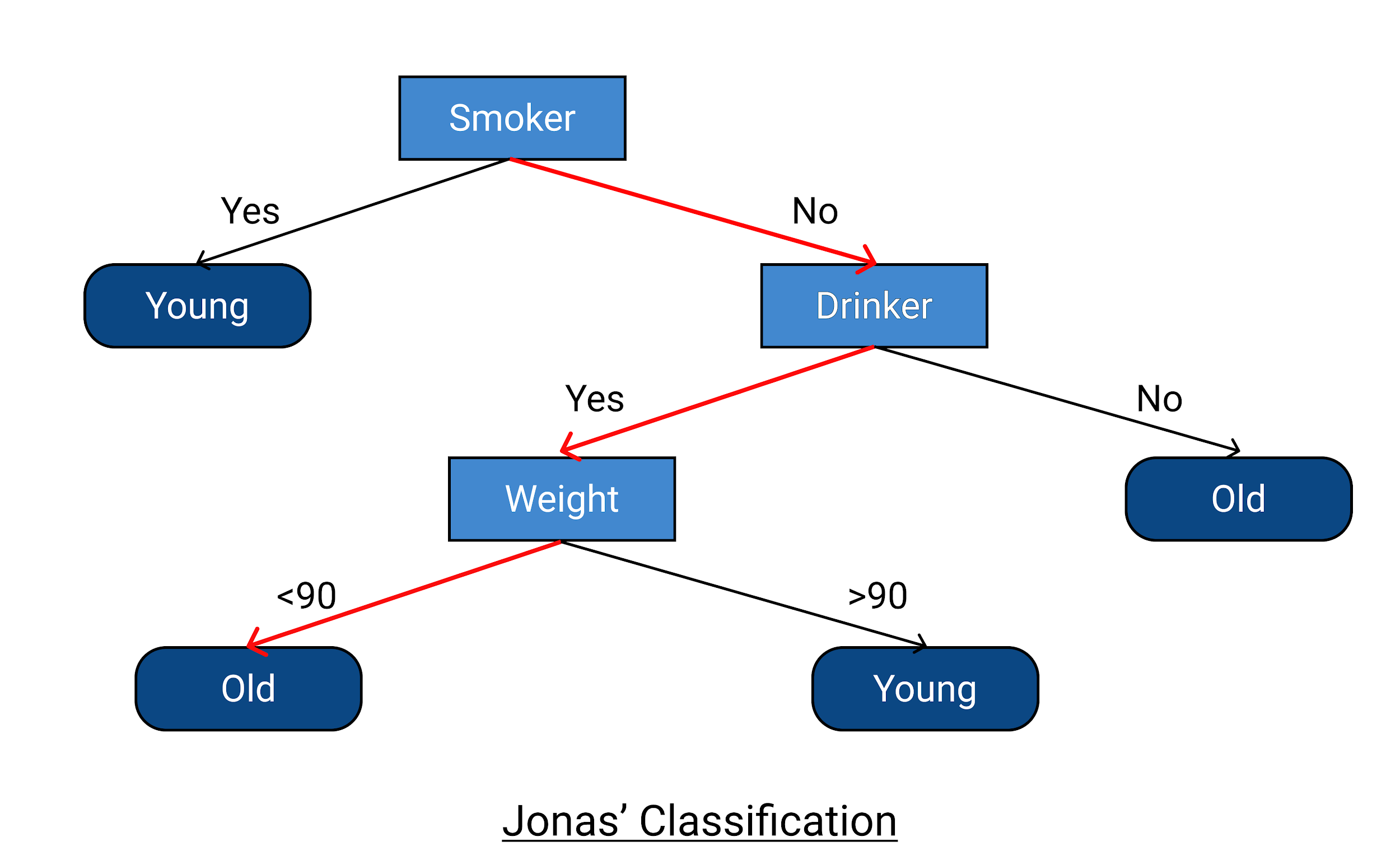

Dai dati forniti prendiamo l'esempio di Jonas per verificare se l'albero decisionale è classificato correttamente e se prevede correttamente la variabile di risposta. Jonas non fuma, beve e pesa meno di 90 kg. Secondo l'albero decisionale, morirà vecchio (età in cui muore>70). Inoltre, secondo i dati, è morto quando aveva 88 anni, questo significa che l' esempio dell'albero decisionale è stato classificato correttamente e ha funzionato perfettamente.

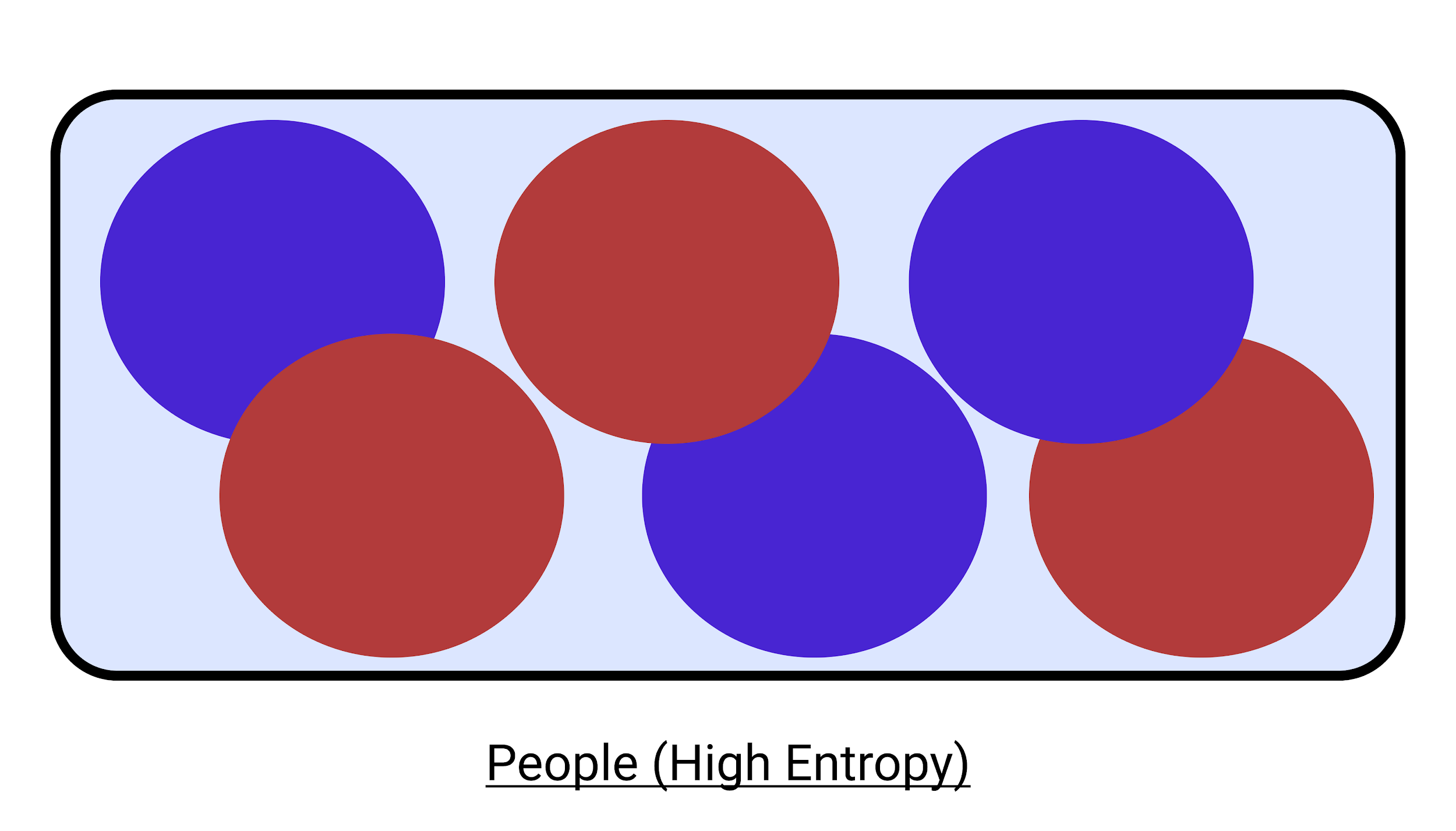

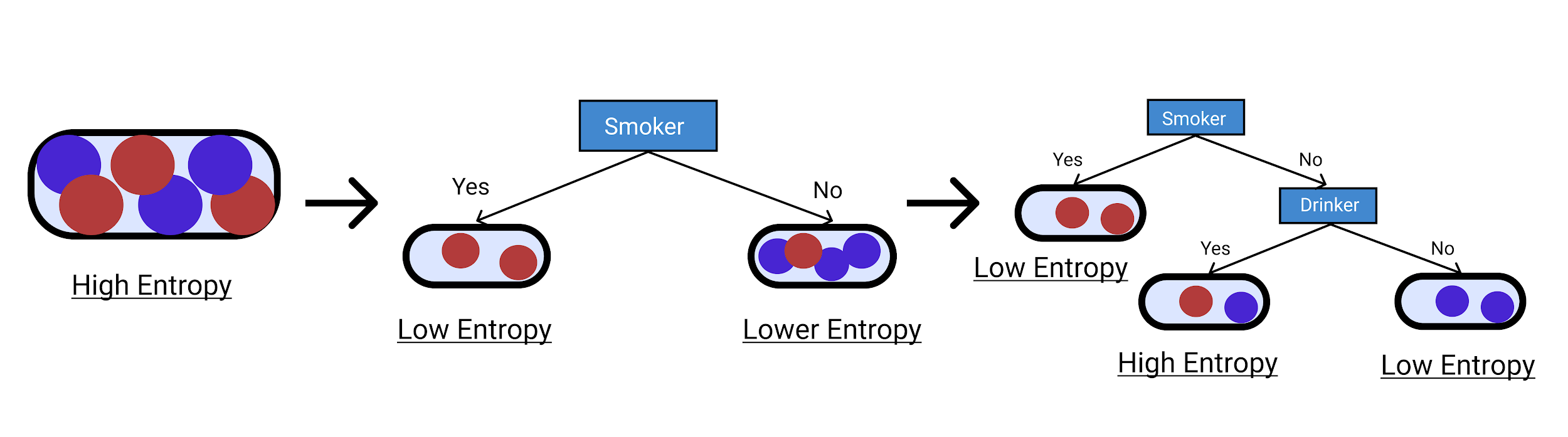

Ma ti sei mai chiesto quale sia l'idea di base dietro il funzionamento di un albero decisionale? In un albero decisionale, l'insieme di istanze è suddiviso in sottoinsiemi in modo che la variazione in ogni sottoinsieme si riduca. Cioè, vogliamo ridurre l'entropia e, quindi, la variazione viene ridotta e si tenta di rendere puro l'evento o l'istanza.

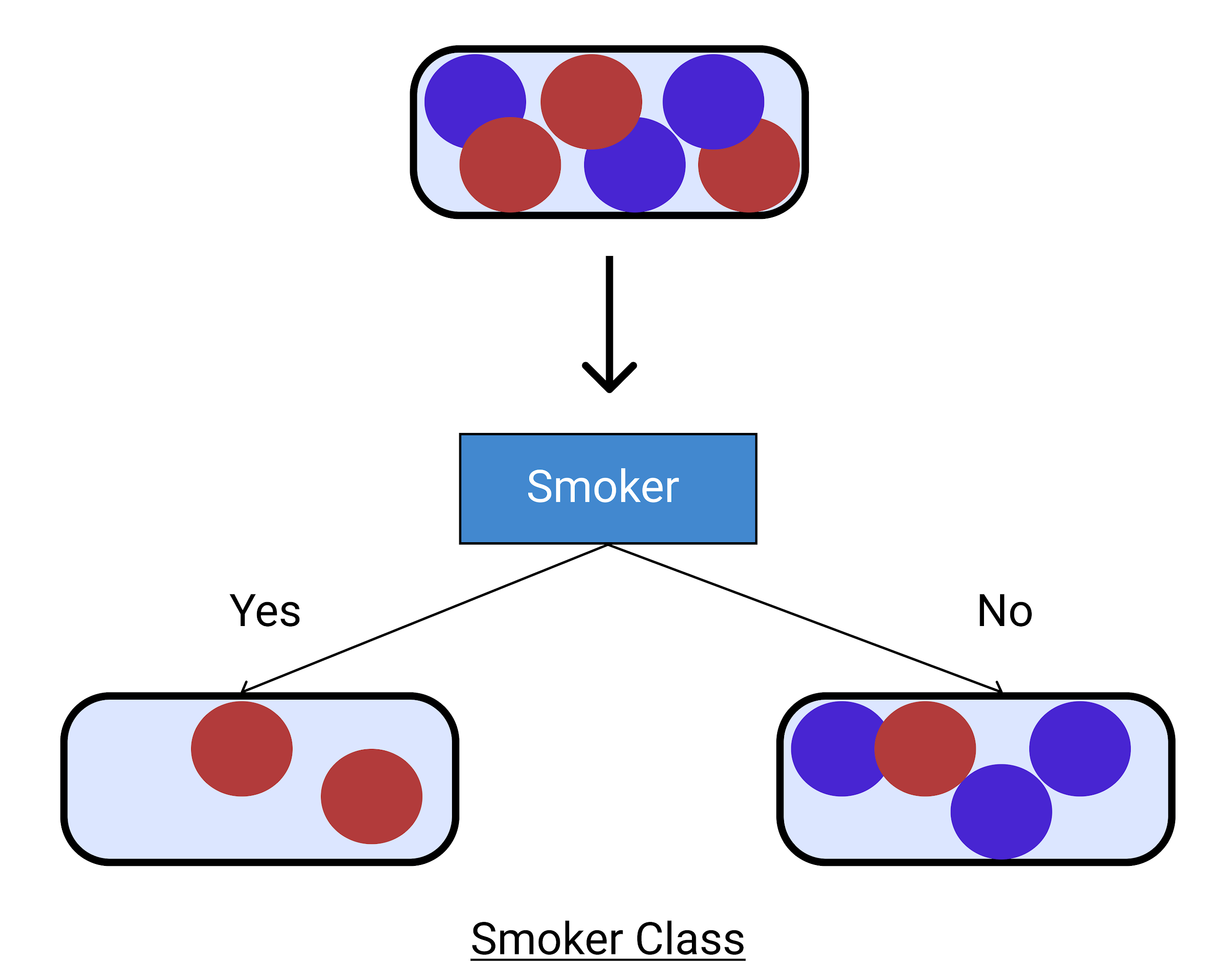

Consideriamo un esempio di albero decisionale simile . In primo luogo, consideriamo se la persona è un fumatore o meno.

Qui siamo incerti sui non fumatori. Quindi, lo dividiamo in bevitore e non bevitore.

Possiamo vedere dal diagramma riportato di seguito che siamo passati da un'entropia elevata con grandi variazioni a ridurla a una classe più piccola in cui siamo più certi. In questo modo, puoi creare in modo incrementale qualsiasi esempio di albero decisionale .

Costruiamo un albero decisionale usando l'algoritmo ID3. Ciò che è più importante nell'albero decisionale è una forte comprensione dell'entropia. L'entropia non è altro che il grado di incertezza. È dato da:

![]()

(A volte è indicato anche con "E")

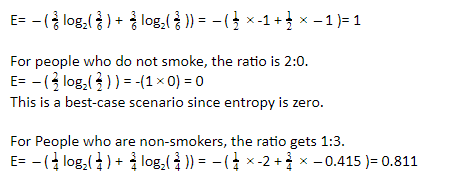

Se lo applichiamo all'esempio sopra, andrà come segue:

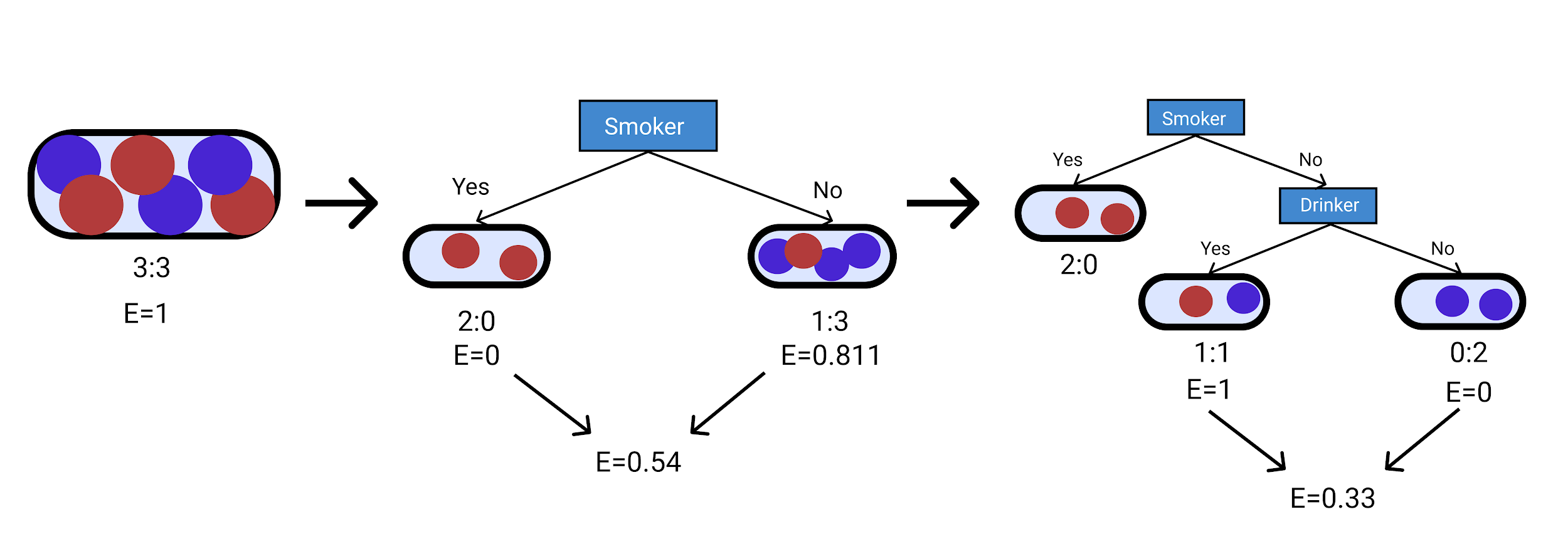

Considera il caso in cui non abbiamo persone divise in nessuna categoria. È uno scenario peggiore (alta entropia) quando entrambi i tipi di persone hanno la stessa quantità. Il rapporto qui è 3:3.

Allo stesso modo, per le persone che non bevono, hanno un rapporto 1:1 e l'entropia sarebbe 1. Pertanto, ha bisogno di un'ulteriore divisione a causa dell'incertezza. Per le persone che non bevono, il rapporto è 2:0. Quindi, l'entropia è 0.

Ora, abbiamo calcolato l'entropia per i diversi casi e quindi possiamo calcolare la media pesata per lo stesso.

Per il primo ramo, E= 6 6 1=1

Per la classe Fumatore, E= 2 6 0+ 4 6 0,811=0,54

Per la classe dei fumatori e dei bevitori, E= 2 6 0+ 2 6 1+ 2 6 0=0,33

Il diagramma seguente ti aiuterà a comprendere rapidamente i calcoli di cui sopra.

Infine, le informazioni guadagnano:

| Classe | Entropia | Guadagno di informazioni (E2-E1) |

| Le persone | 1 | 0,46 |

| Fumatore | 0,54 | 0,21 |

| Fumatore + bevitore | 0,33 | – |

Leggi anche: Domande e risposte sull'intervista sull'albero decisionale

Conclusione

Abbiamo studiato con successo gli alberi decisionali in profondità, dalla teoria a un esempio pratico di albero delle decisioni . Abbiamo anche costruito un albero decisionale utilizzando l'algoritmo ID3. Se l'hai trovato interessante, ti piacerebbe esplorare la scienza dei dati in dettaglio.

Se sei interessato a saperne di più sugli alberi decisionali, sull'apprendimento automatico, dai un'occhiata al Diploma PG di IIIT-B e upGrad in Machine Learning e AI, progettato per i professionisti che lavorano e offre oltre 450 ore di formazione rigorosa, oltre 30 casi di studio e incarichi , status di Alumni IIIT-B, oltre 5 progetti pratici pratici e assistenza sul lavoro con le migliori aziende.

Cosa sono gli alberi decisionali?

Gli alberi decisionali vengono utilizzati per organizzare visivamente e organizzare le informazioni sul processo decisionale. Gli alberi sono disegnati in modo tale che la radice sia in alto e le foglie in basso. Gli alberi decisionali vengono letti dal basso verso l'alto, spostandosi da sinistra a destra. Ogni livello dell'albero è una base per ulteriori test e le decisioni a ciascun livello restringeranno l'ambito fino a quando la domanda non avrà risposta. Un albero decisionale suddivide un problema o una decisione in più sottodecisioni e segue il percorso logico alla radice, che è l'obiettivo principale. Gli alberi decisionali vengono utilizzati per analizzare l'ambiente aziendale, stabilire le priorità e fornire informazioni dettagliate, al fine di prendere decisioni sulla direzione da prendere.

Quali sono i problemi nell'apprendimento dell'albero decisionale nell'apprendimento automatico?

Gli alberi decisionali possono essere usati come base per testare nuove strategie o per spiegare strategie ad altri. Un albero decisionale spiega cosa accadrà sotto un dato insieme di ipotesi. Possono essere utilizzati anche per valutare la performance di una strategia utilizzata in passato. È noto che gli alberi decisionali sono troppo suscettibili agli errori a causa di tutti i loro rami. Gli alberi decisionali non sono sempre accurati perché, a volte, non tengono conto di tutte le possibili variabili e la persona che analizza l'albero decisionale potrebbe non essere esperta in tutti gli aspetti della situazione particolare.

Che tipo di dati è meglio per gli alberi decisionali?

Gli alberi decisionali ti aiutano a trovare modelli nei dati utilizzando una struttura simile a un diagramma di flusso. Il miglior tipo di dati sarebbe qualitativo, categoriale e numerico. Sebbene gli alberi decisionali funzionino con tutti i tipi di dati, funzionano meglio con i dati numerici. Devono essere in grado di avere valori che sono numeri o dovrebbe esserci un modo per tradurli in numeri. Gli alberi decisionali dipendono fortemente dal tipo di dati e dalla quantità. Se il numero di punti dati è superiore a 100, Decision Trees sarebbe un buon modello.