Explicación del árbol de decisiones en el aprendizaje automático [con ejemplos]

Publicado: 2020-12-21Introducción

Decision Tree Learning es una técnica de minería de datos convencional y es una forma de aprendizaje automático supervisado. Un árbol de decisión es como un diagrama mediante el cual las personas representan una probabilidad estadística o encuentran el curso de lo que sucede, la acción o el resultado. Un ejemplo de árbol de decisiones hace que sea más claro entender el concepto.

Las ramas en el diagrama de un árbol de decisión muestran un resultado probable, una posible decisión o una reacción. La rama al final del árbol de decisión muestra la predicción o un resultado. Los árboles de decisión se utilizan generalmente para encontrar una solución a un problema que se vuelve complicado de resolver manualmente. Comprendamos esto en detalle con la ayuda de algunos ejemplos de árboles de decisión.

Un árbol de decisiones es una de las herramientas populares y poderosas que se utiliza para la predicción y clasificación de los datos o un evento. Es como un diagrama de flujo pero con una estructura de árbol. Los nodos internos de los árboles representan una prueba o una pregunta sobre un atributo; cada rama es el resultado posible de la pregunta formulada, y el nodo terminal, que también se denomina nodo hoja, denota una etiqueta de clase.

En un árbol de decisión, tenemos varias variables predictoras. Dependiendo de estas variables predictoras, intente predecir la llamada variable de respuesta.

Lectura relacionada: Clasificación del árbol de decisión: todo lo que necesita saber

Árbol de decisión en ML

Al representar unos pocos pasos en forma de secuencia, el árbol de decisiones se convierte en una forma fácil y efectiva de comprender y visualizar las posibles opciones de decisión y los posibles resultados del rango. Los árboles de decisión también son útiles para identificar posibles opciones y sopesar las recompensas y los riesgos frente a cada curso de acción que se puede producir.

Un árbol de decisiones se implementa en muchas organizaciones de pequeña y gran escala como una especie de sistema de apoyo en la toma de decisiones. Dado que un ejemplo de árbol de decisiones es un modelo estructurado, los lectores pueden comprender el gráfico y analizar cómo y por qué una opción en particular puede conducir a una decisión correspondiente. El ejemplo del árbol de decisión también le permite al lector predecir y obtener múltiples soluciones posibles para un solo problema, comprender el formato y la relación entre diferentes eventos y datos con la decisión.

Cada resultado en el árbol tiene asignado un número o peso de recompensa y riesgo. Si alguna vez usa un árbol de decisiones, tendrá todos los resultados finales con un posible inconveniente y beneficio. Para concluir correctamente su árbol, puede extenderlo tanto como sea necesario según el evento y la cantidad de datos. Tomemos un ejemplo de árbol de decisión simple para entenderlo mejor.

Considere los datos proporcionados que consisten en detalles de personas como: si beben, fuman, su peso y la edad a la que murieron estas personas.

| Nombre | Bebedor | Fumador | Peso | Edad (Murió) |

| Sam | sí | sí | 120 | 44 |

| María | No | No | 70 | 96 |

| jonas | sí | No | 72 | 88 |

| taylor | sí | sí | 55 | 52 |

| José | No | sí | 94 | 56 |

| Harry | No | No | 62 | 93 |

Tratemos de predecir si las personas morirán a una edad más temprana o más avanzada. Las características como bebedor, fumador y el peso actuarán como valor predictor. Usando estos, consideraremos la edad como una variable de respuesta.

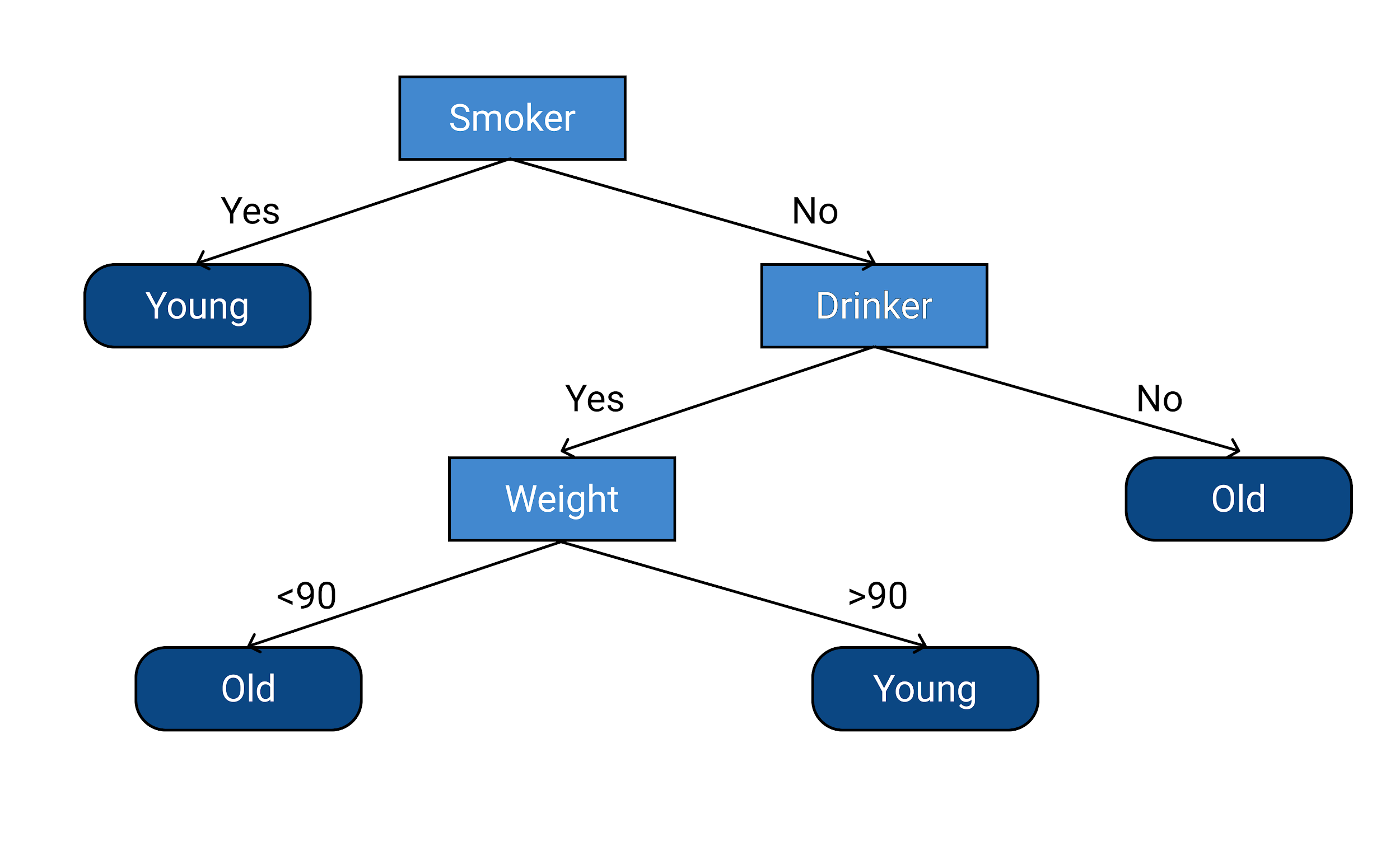

Etiquetemos que las personas que murieron antes de los 70 años murieron “jóvenes” y las personas que murieron después de los 70 años murieron “viejas”. Predigamos ahora la variable de respuesta en función de la variable predictora. A continuación se muestra un árbol de decisiones realizado después de conocer los datos.

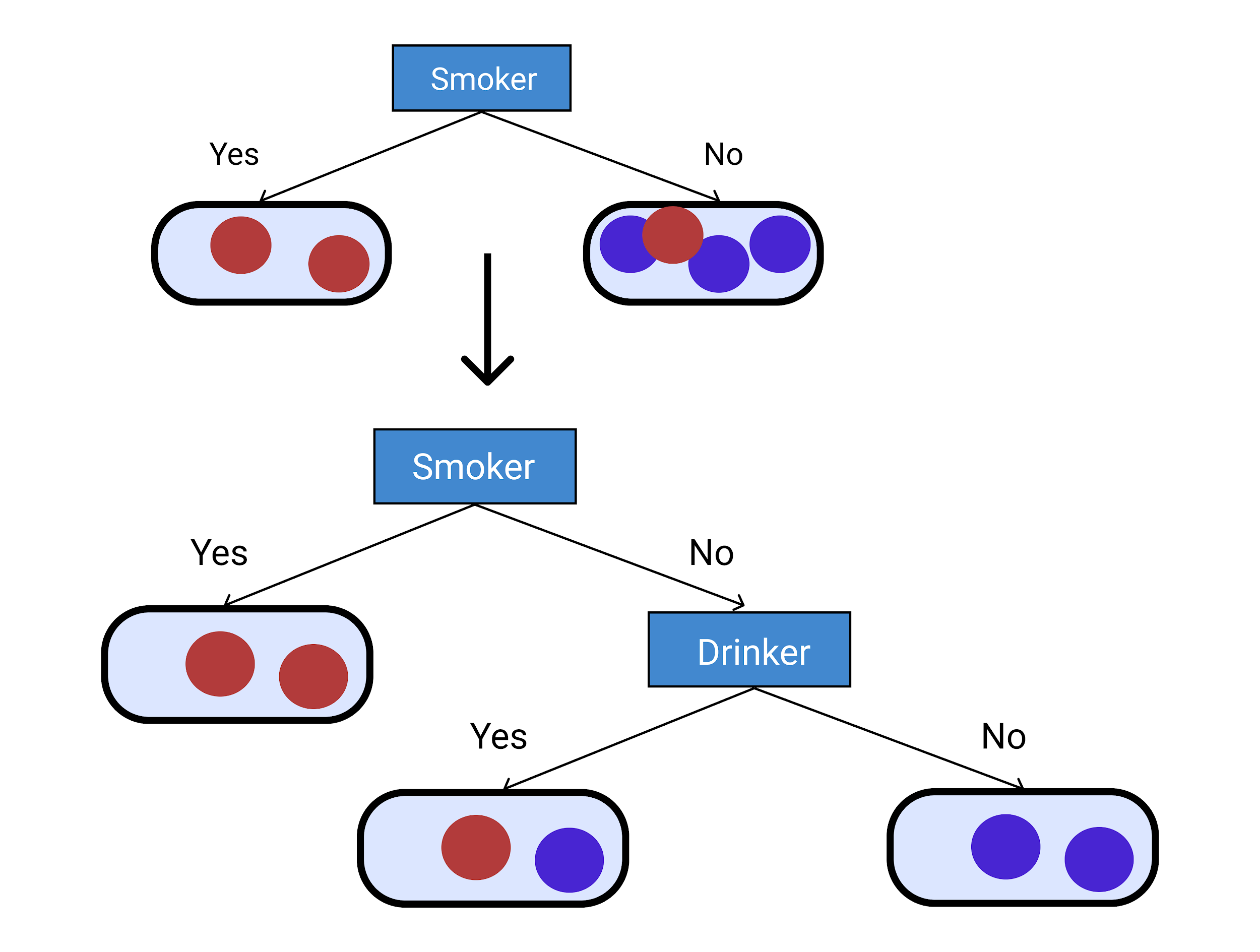

El árbol de decisión anterior explica que, si una persona es fumadora, muere joven. Si una persona no es fumadora, el siguiente factor a considerar es si la persona es bebedora o no. Si una persona no es fumadora ni bebedora, la persona muere vieja.

Si una persona no es fumadora y es bebedora, entonces se considera el peso de la persona. Si una persona no es fumadora, es bebedora y pesa menos de 90 kg, entonces la persona muere vieja. Y por último, si una persona no es fumadora, es bebedora y pesa más de 90 kg, muere joven.

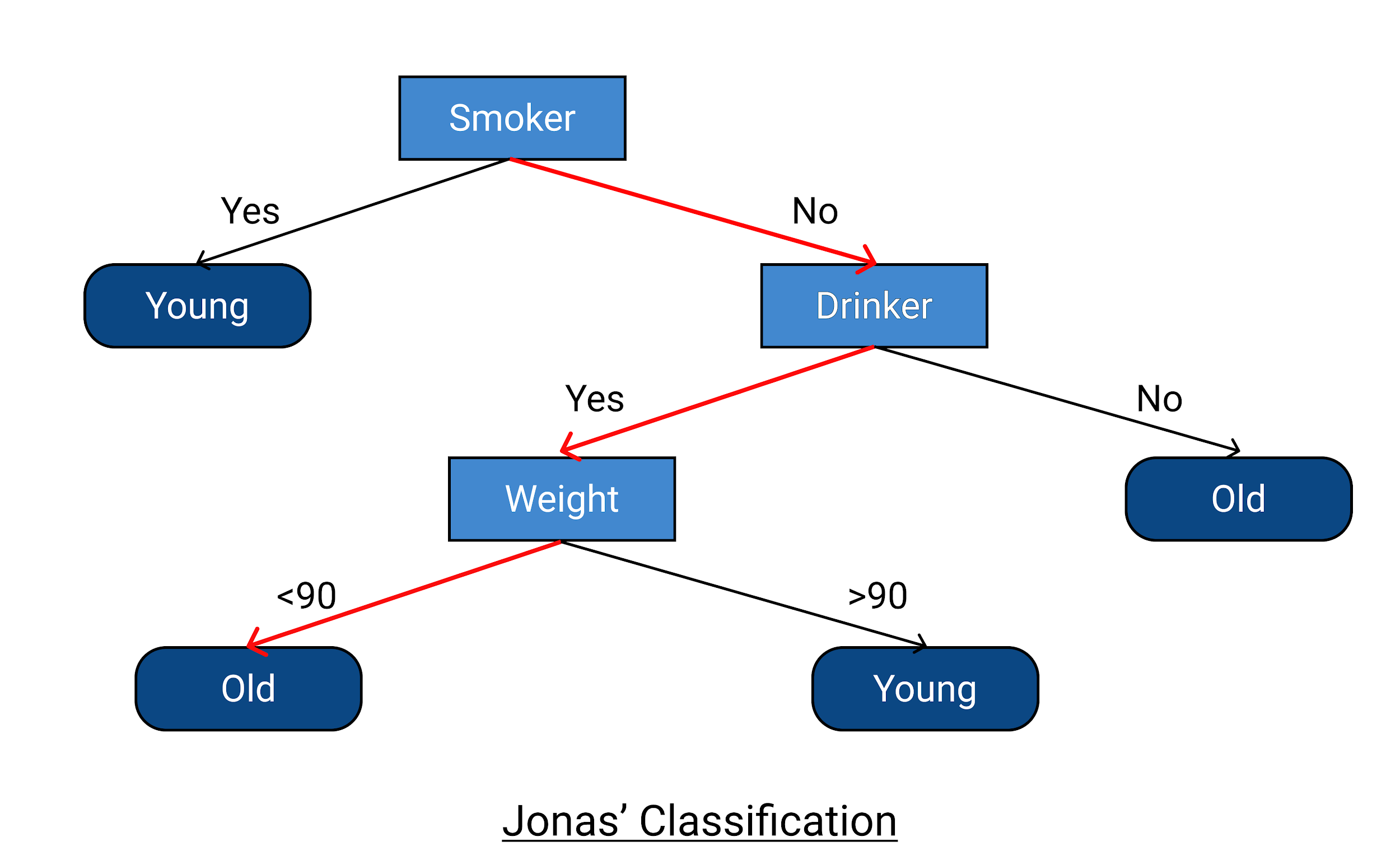

A partir de los datos proporcionados, tomemos el ejemplo de Jonas para comprobar si el árbol de decisión está clasificado correctamente y si predice correctamente la variable de respuesta. Jonas no fuma, es bebedor y pesa menos de 90 kg. Según el árbol de decisión, morirá viejo (edad a la que muere >70). Además, según los datos, murió cuando tenía 88 años, lo que significa que el ejemplo del árbol de decisión se ha clasificado correctamente y funcionó a la perfección.

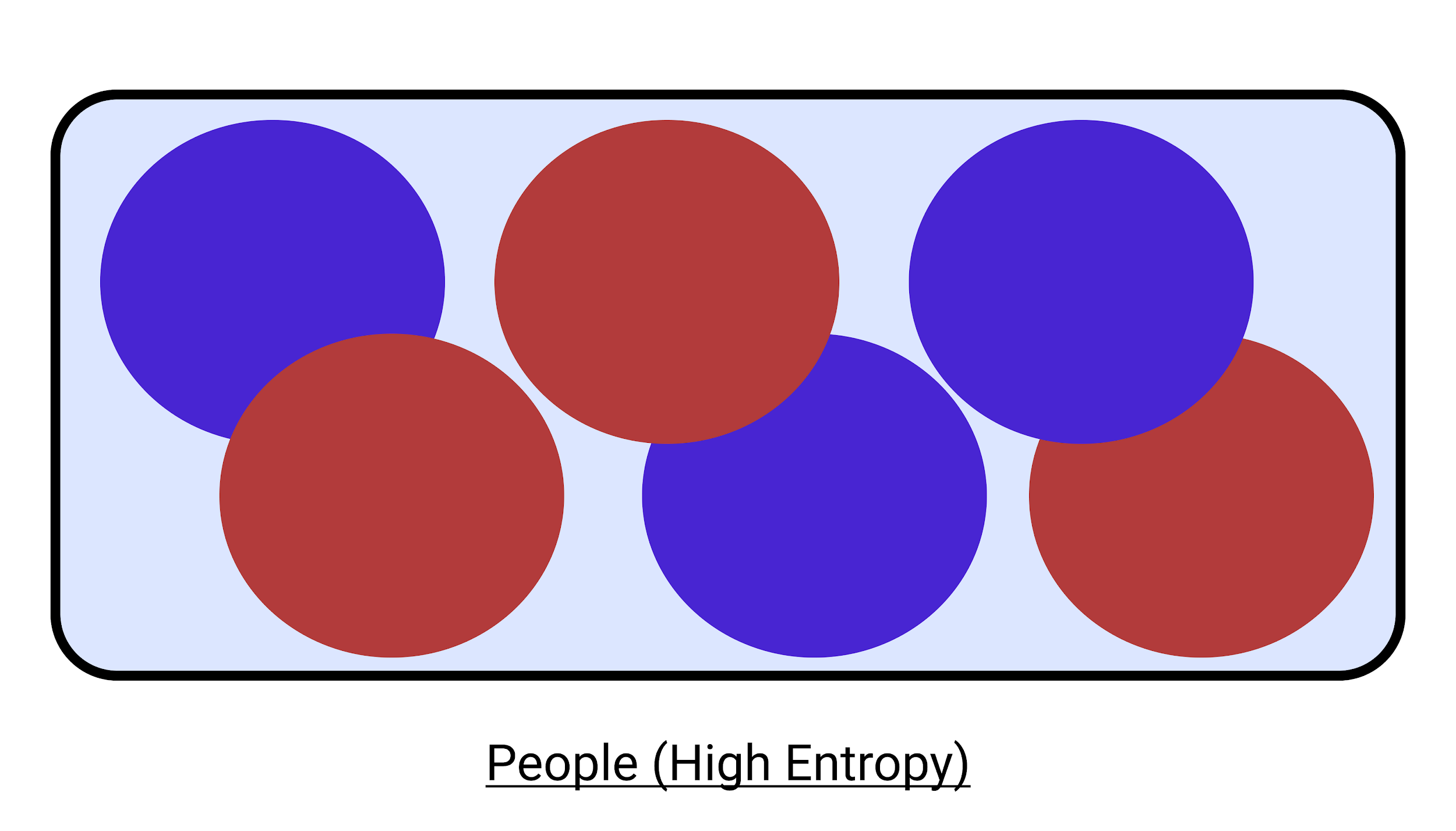

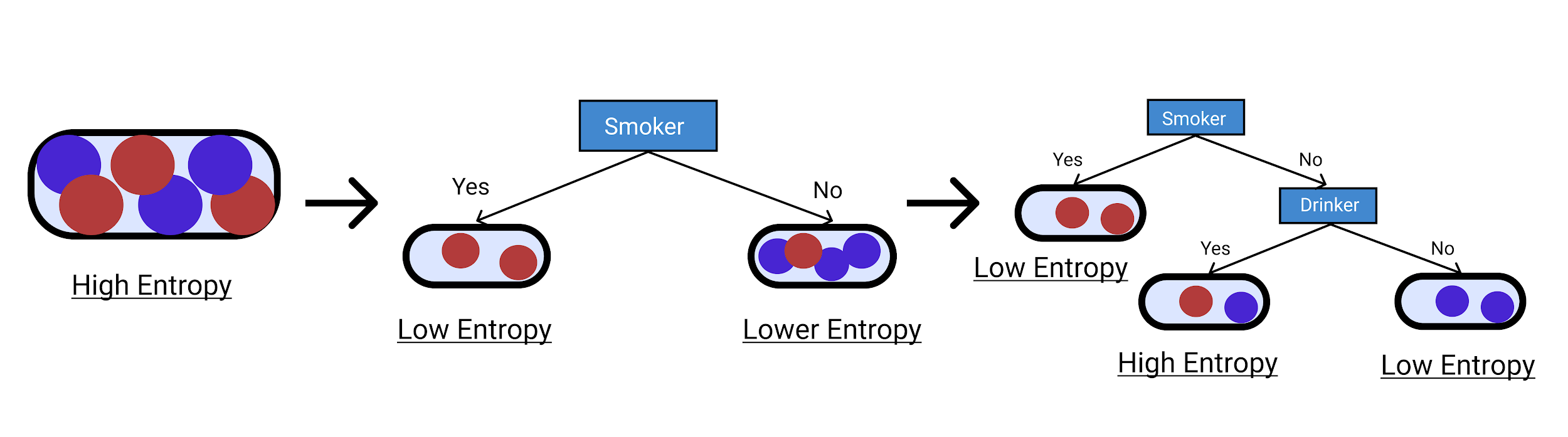

Pero, ¿alguna vez se preguntó acerca de la idea básica detrás del funcionamiento de un árbol de decisión? En un árbol de decisión, el conjunto de instancias se divide en subconjuntos de manera que la variación en cada subconjunto se hace más pequeña. Es decir, queremos reducir la entropía, y por lo tanto, se reduce la variación y se intenta purificar el evento o instancia.

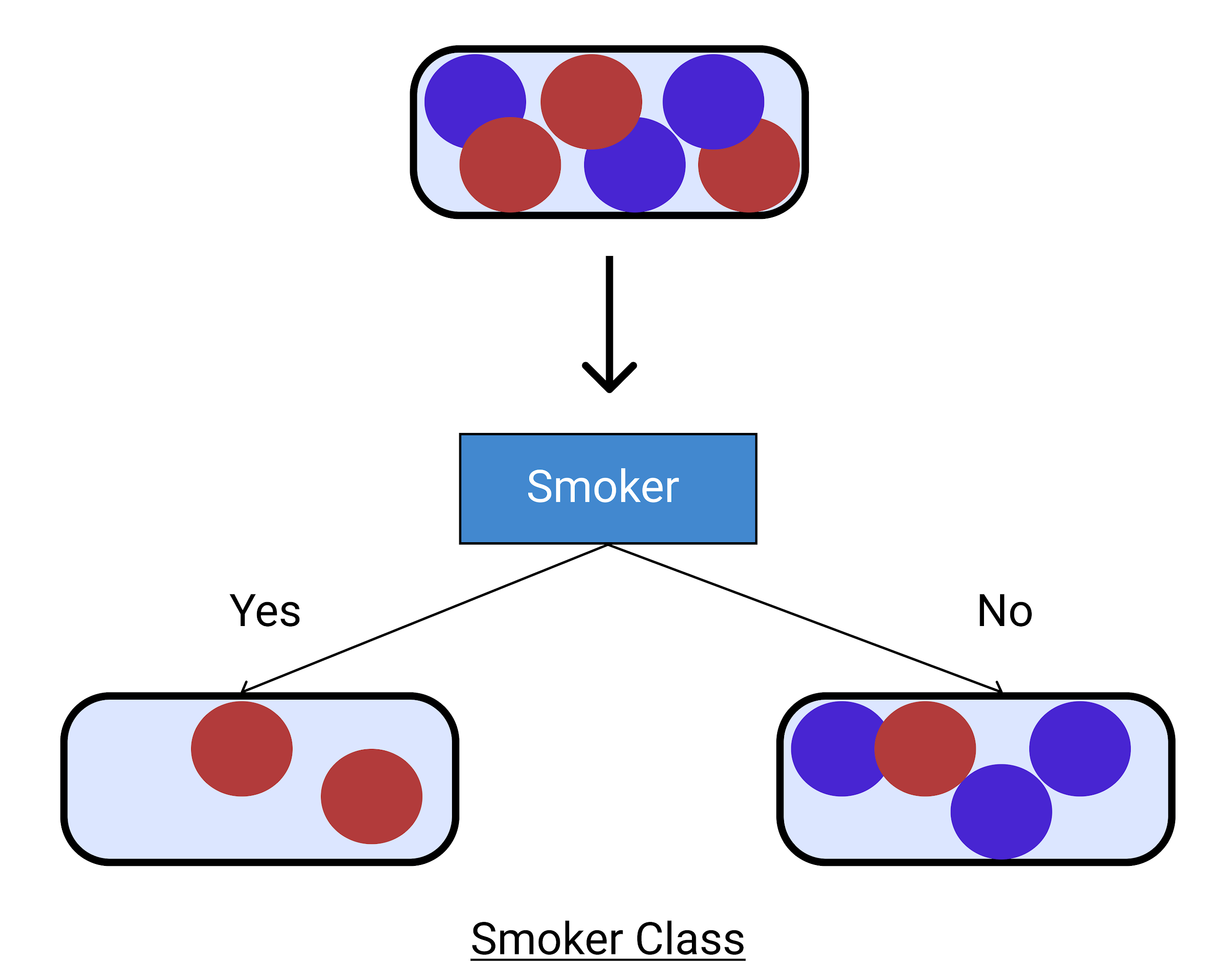

Consideremos un ejemplo de árbol de decisión similar . En primer lugar, consideramos si la persona es fumadora o no.

Aquí, no estamos seguros acerca de los no fumadores. Entonces, lo dividimos en bebedor y no bebedor.

Podemos ver en el diagrama que se muestra a continuación que pasamos de una entropía alta que tiene una gran variación a reducirla a una clase más pequeña en la que estamos más seguros. De esta manera, puede crear de forma incremental cualquier ejemplo de árbol de decisión .

Construyamos un árbol de decisión usando el Algoritmo ID3. Lo que es más importante en el árbol de decisiones es una sólida comprensión de la entropía. La entropía no es más que el grado de incertidumbre. Está dado por:

![]()

(A veces, también se denota por "E")

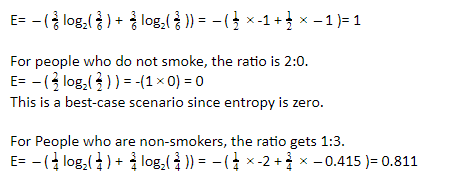

Si lo aplicamos al ejemplo anterior, quedará de la siguiente manera:

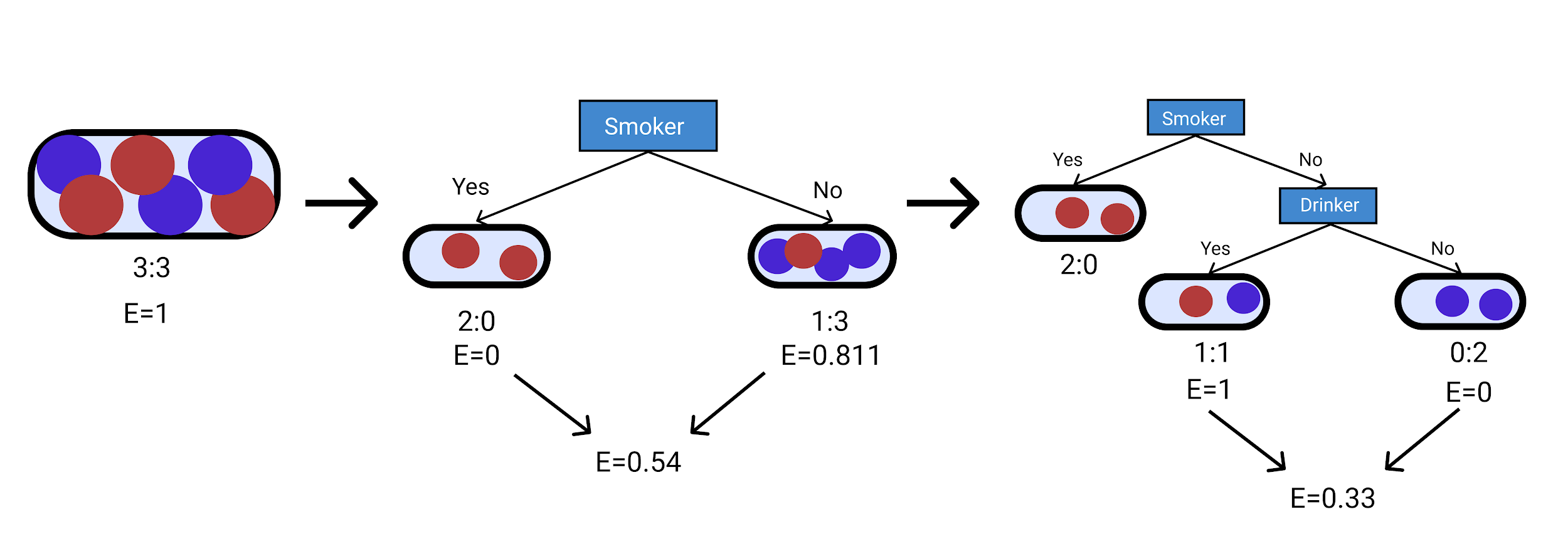

Considere el caso cuando no tenemos personas divididas en ninguna categoría. Es el peor de los casos (alta entropía) cuando ambos tipos de personas tienen la misma cantidad. La proporción aquí es 3:3.

De manera similar, para las personas que no beben, tienen una proporción de 1:1 y la entropía sería 1. Por lo tanto, necesita una división adicional debido a la incertidumbre. Para las personas que no beben, la proporción es de 2:0. Por lo tanto, la entropía es 0.

Ahora, hemos calculado la entropía para los diferentes casos y, por lo tanto, podemos calcular el promedio ponderado de los mismos.

Para la primera rama, E= 6 6 1=1

Para la clase Fumador, E= 2 6 0+ 4 6 0.811=0.54

Para la clase fumador y bebedor, E= 2 6 0+ 2 6 1+ 2 6 0=0.33

El siguiente diagrama lo ayudará a comprender rápidamente los cálculos anteriores.

Finalmente, la ganancia de información:

| Clase | entropía | Ganancia de información (E2-E1) |

| Gente | 1 | 0.46 |

| Fumador | 0.54 | 0.21 |

| Fumador+Bebedor | 0.33 | – |

Lea también: Preguntas y respuestas de la entrevista del árbol de decisiones

Conclusión

Hemos estudiado con éxito los árboles de decisión en profundidad desde la teoría hasta un ejemplo práctico de árbol de decisión . También construimos un árbol de decisión usando el algoritmo ID3. Si le pareció interesante, le encantará explorar la ciencia de datos en detalle.

Si está interesado en obtener más información sobre árboles de decisión, aprendizaje automático, consulte el Diploma PG en aprendizaje automático e IA de IIIT-B y upGrad, que está diseñado para profesionales que trabajan y ofrece más de 450 horas de capacitación rigurosa, más de 30 estudios de casos y asignaciones. , estado de exalumno de IIIT-B, más de 5 proyectos prácticos finales y asistencia laboral con las mejores empresas.

¿Qué son los árboles de decisión?

Los árboles de decisión se utilizan para organizar y organizar visualmente la información de toma de decisiones. Los árboles se dibujan de modo que la raíz esté en la parte superior y las hojas en la parte inferior. Los árboles de decisión se leen de abajo hacia arriba, moviéndose de izquierda a derecha. Cada nivel del árbol es una base para realizar más pruebas y las decisiones en cada nivel reducirán el alcance hasta que se responda la pregunta. Un árbol de decisión divide un problema o decisión en varias subdecisiones y sigue el camino lógico hasta la raíz, que es el objetivo principal. Los árboles de decisión se utilizan para analizar el entorno empresarial, para priorizar y proporcionar información, a fin de tomar decisiones sobre qué dirección tomar.

¿Cuáles son los problemas en el aprendizaje del árbol de decisiones en el aprendizaje automático?

Los árboles de decisión se pueden utilizar como base para probar nuevas estrategias o para explicar estrategias a otros. Un árbol de decisión explica lo que sucederá bajo un conjunto dado de supuestos. También se pueden utilizar para evaluar el rendimiento de una estrategia que se utilizó en el pasado. Se sabe que los árboles de decisión son demasiado susceptibles a errores debido a todas sus ramas. Los árboles de decisión no siempre son precisos porque, a veces, no tienen en cuenta todas las variables posibles y es posible que la persona que analiza el árbol de decisión no tenga experiencia en todos los aspectos de la situación particular.

¿Qué tipo de datos son mejores para los árboles de decisión?

Los árboles de decisión lo ayudan a encontrar patrones en los datos utilizando una estructura similar a un diagrama de flujo. El mejor tipo de datos sería cualitativo, categórico y numérico. Aunque los árboles de decisión funcionan con todo tipo de datos, funcionan mejor con datos numéricos. Deben poder tener valores que sean números o debe haber una manera de traducirlos a números. Los árboles de decisión dependen en gran medida del tipo de datos y de la cantidad. Si el número de puntos de datos es superior a 100, los árboles de decisión serían un buen modelo.